NIS+

NIS+(Neural Information Squeezer Plus)是一个机器学习框架,可学习宏观动力学,并量化因果涌现的程度。该框架通过最大化有效信息,得到一个宏观动态模型。通过在模拟数据和实际数据上的实验,证明了该框架的有效性。且该框架在不同测试环境里都表现出泛化的效果。

问题背景

在自然界和人类社会中,存在着许多由无数相互作用的元素构成的复杂系统,如气候系统、生态系统、鸟群、蚁群、细胞和大脑等。这些系统展现出丰富的非线性动力学行为,它们的行为模式复杂且难以预测。同时,复杂系统具有涌现现象,即系统的整体行为超越了其组成部分的简单总和,整体展现出其组成部分所不具备的新特性,这是理解宏观与微观之间关系的关键。(复杂系统涌现)

涌现性与因果关系紧密相连。一方面,涌现性是系统内部各元素间复杂非线性相互作用的结果;另一方面,这些涌现的特性又会对系统中的个体产生影响。因果涌现描述了宏观层面相对于微观层面在因果效应上的增强,揭示了宏观与微观状态之间的差异和联系。

因果涌现的概念不仅将人工智能中的因果推理与复杂系统的涌现特性相结合,而且为解决一系列哲学问题提供了一个定量化的视角。(涌现和因果)

目前,关于如何定义因果涌现,有四个主要代表,分别是:①Erik Hoel等基于粗粒化方法的因果涌现理论、②Rosas等基于信息分解的因果涌现理论、③张江等人基于奇异值分解的因果涌现理论、④Barnett L等的动力学解耦。具体内容可以参考词条因果涌现。(因果涌现理论)

因果涌现识别

识别出复杂系统中的因果涌现,一方面可以节约预测成本,增强预测效果,尤其是泛化效果;一方面也可以诱导或者预防涌现的发生。在实际应用中,一些微观数据难以捕捉,我们往往只能收集到观测数据,并且,无法得到系统的真实动力学。因此,从可观测数据中识别系统中因果涌现的发生是一个关键的问题。近年来,基于神经网络的机器学习方法取得了突破性进展,借助此方法,以数据驱动的方式自主发现复杂系统的因果关系甚至动力学成为可能。此外,机器学习和神经网络还可以帮助我们找到更好的粗粒化策略、从数据中发现宏观层面的因果关系。(数据驱动)

下面介绍两种因果涌现的识别方法:①基于互信息的近似方法、②神经信息压缩器方法系列(Neural Information Squeezer,简称NIS)。

基于信息分解的因果涌现识别

Rosas等学者通过将过量熵(即系统现在与未来状态的互信息)分解成不重叠的部分来识别量化因果涌现,且提出了判定因果涌现发生的充分条件,当[math]\displaystyle{ \mathrm{\Psi}\gt 0 }[/math]时,宏观状态[math]\displaystyle{ V }[/math]会发生涌现。

为了简化问题且不失通用性,以有两个输入变量(X1、X2)和一个输出变量(Y)的系统为例,目标变量和联合源变量的互信息[math]\displaystyle{ I(X_1,X_2; Y) }[/math]可以通过部分信息分解(Partial Information Decomposition,简称PID)分解成三种信息,分别是冗余信息(Redundant information,简称Red)、独特信息(Unique information,简称Un)、协同信息(Synergistic information,简称Syn),具体公式如下:

[math]\displaystyle{ I(X_1,X_2; Y) = Red(X_1,X_2; Y) + Un(X_1; Y |X_2) + Un(X_2; Y |X_1) + Syn(X_1,X_2; Y) }[/math]

不过,PID只适用于单个目标变量的情景,无法有效的应用于跨时间步长的系统。故,Rosas等学者提出了集成信息分解(Integrated Information Decomposition,简称ΦID)。只有当前后时刻变量(Xt,Xt+1)之间的协同效应大于0的时候,才会出现因果涌现。

[math]\displaystyle{ Syn(X_t;X_t+1) \gt 0 }[/math]

此外,Rosas等学者还提供了量化特定宏观变量(Vt)因果涌现的方法。如果宏观变量(Vt)所持有的关于微观变量独特信息大于0,那么则出现因果涌现。

[math]\displaystyle{ Syn(X_{t};X_{t+1}) ≥ Un(V_t;X_{t+1}|X_t) \gt 0 }[/math]

通过互信息的相关计算公式,可以得知:

[math]\displaystyle{ Un(V_t;X_{t+1}|X_t) ≥ I\left(V_t ; V_{t+1}\right)-\sum_j I\left(X_t^j ; V_{t+1}\right) + Red(V_t, V_{t+1};X_t) }[/math]

式中,[math]\displaystyle{ X_t^j }[/math]表示第 j 维的微观变量。

由于[math]\displaystyle{ Red(V_t, V_{t+1};X_t) }[/math]为非负数,所以可以提出一个充分非必要条件[math]\displaystyle{ \Psi_{t, t+1}(V) }[/math]。当[math]\displaystyle{ \Psi_{t, t+1}(V) \gt 0 }[/math],宏观状态[math]\displaystyle{ V }[/math]发生因果涌现。但当[math]\displaystyle{ \mathrm{\Psi}\lt 0 }[/math],我们不能确定宏观状态[math]\displaystyle{ V }[/math]是否发生涌现,此时需要借助进一步的指标。

[math]\displaystyle{ \Psi_{t, t+1}(V):=I\left(V_t ; V_{t+1}\right)-\sum_j I\left(X_t^j ; V_{t+1}\right) }[/math]

该方法避开讨论粗粒化策略。但是也存在很多缺点:1)该方法只是基于信息分解计算没有考虑因果,同时该方法得到的仅仅是发生因果涌现的充分条件;2)该方法无法得到显式的宏观动力学以及粗粒化策略,然而这两项对于下游的任务往往十分重要;3)当系统具有大量冗余信息或具有许多变量时,该方法的计算复杂度仍然很高。

Kaplanis等人[1]基于机器学习的方法学习宏观态[math]\displaystyle{ V }[/math]以及最大化[math]\displaystyle{ \mathrm{\Psi} }[/math]:使用[math]\displaystyle{ f_{\theta} }[/math]神经网络来学习将微观输入[math]\displaystyle{ X_t }[/math]粗粒化成宏观输出[math]\displaystyle{ V_t }[/math],同时使用神经网络[math]\displaystyle{ g_{\phi} }[/math]和[math]\displaystyle{ h_{\xi} }[/math]来分别学习[math]\displaystyle{ I(V_t;V_{t+1}) }[/math]和[math]\displaystyle{ \sum_i(I(V_{t+1};X_{t}^i)) }[/math]两者互信息的计算,最后通过最大化两者之间的差(即[math]\displaystyle{ \mathrm{\Psi} }[/math])来优化学习。 (暂定)

NIS系列

张江等[2]尝试基于神经网络和数据驱动提出了一种方法,该方法能从时间序列数据中识别系统中的因果涌现,并且自动提取有效的粗粒度策略和宏观动力学,即神经信息压缩器(Neural Information Squeezer,简称NIS)。

模型由编码器(encoder)、动力学学习器([math]\displaystyle{ f }[/math])以及解码器(decoder)三个部分构成,编码器和解码器主要由可逆神经网络(Invertible Neural Network,简称INN)构建,动力学学习器由神经网络(Neural Network,简称NN)构建。此模型框架可以看成是一个神经信息压缩器,将包含噪音的微观态压缩成宏观态,丢弃无用的信息,从而使得宏观动力学的因果性更强。NIS方法的模型框架如图所示。(加图)

具体来说,模型输入是微观状态[math]\displaystyle{ X_t\ (X_t^1,X_t^2,…,X_t^p ) }[/math],[math]\displaystyle{ p }[/math]表示输入数据的维数,输出预测下一个时刻的微观状态[math]\displaystyle{ \hat{X}_{t+1}\left(\hat{X}_{t+1}^1, \hat{X}_{t+1}^2, \ldots, \hat{X}_{t+1}^p\right) }[/math],该方法的目标函数是希望保证微观状态预测误差很小的条件下最大化有效信息,在保证预测误差约束足够小的情况下,NIS方法可以避免trivial解的出现。

具体计算公式如下所示:

[math]\displaystyle{ \max_{\phi_q,\hat{f}_{\phi_q},\phi_q^†,q} \mathcal{I}(\hat{f}_{\phi_q}) }[/math]

[math]\displaystyle{ \text{s.t.}\left\|\phi_q^{\dagger}(Y(t+1))-X_{t+1}\right\|\lt \epsilon }[/math]

最终希望得到有效的粗粒化维度[math]\displaystyle{ q }[/math]、粗粒化策略[math]\displaystyle{ \mathrm{\phi}_q }[/math]和宏观动力学[math]\displaystyle{ {\hat{f}}_{\mathrm{\phi}_q} }[/math]。

然而由于该目标函数是一个泛函优化问题,往往很难优化。为了解决这个问题,将优化过程分为两个阶段。

第一个阶段:在给定宏观尺度[math]\displaystyle{ q }[/math]的情况下,使[math]\displaystyle{ \left\|\phi_q^{\dagger}(Y(t+1))-X_{t+1}\right\|\lt \epsilon }[/math]最小。

第二个阶段:由于参数 [math]\displaystyle{ q }[/math] 是一维的,且 [math]\displaystyle{ 0 \lt q \lt p }[/math],简单迭代找到有效信息最大的宏观尺度。

总的来说,NIS是一种新的神经网络框架,可被用于发现时间序列数据中的粗粒化策略、宏观动力学和涌现的因果关系。但是,此方法并未真正地最大化有效信息,可预测的条件分布也仅限于高斯或者拉普拉斯分布。

具体内容请参考NIS。

机器学习领域的分布外泛化问题

分布外泛化(Out-of-Distribution Generalization,简称OOD Generalization)是指模型在面对与训练数据分布不同的新数据时,仍然能够保持较好的性能,涉及到模型对未知或未见情况的适应能力。

此问题通常表现为模型在训练集上运行良好,但在面对分布外的各种数据时,模型性能有所下降。造成这个问题的原因可能是过度拟合训练数据,导致泛化能力差;也可能是由于训练数据无法覆盖所有可能的输入情况,特别是对于罕见或极端的情况。

为了提高模型的OOD泛化能力,可以增加训练数据的多样性、使用Dropout、元学习等方法。

神经信息压缩机(NIS)介绍

假设复杂动态系统的行为数据是时间序列 [math]\displaystyle{ \{x_t\} }[/math],时间步长[math]\displaystyle{ t = 1,2,…, T }[/math],维数是p,它们构成了可观测的微观状态,我们假设不存在未观测变量。一个粗粒化策略 [math]\displaystyle{ ϕ: R_p → R_q }[/math] ,其中 [math]\displaystyle{ q ≤ p }[/math], 是宏观状态的维度,作为超参数给定;一个相应的反粗粒化策略[math]\displaystyle{ ϕ^\dagger: R_q → R_p }[/math],以及一个宏观层面的马尔可夫动力学[math]\displaystyle{ f_q }[/math] ,使得[math]\displaystyle{ f_q }[/math]的有效信息(EI)值在[math]\displaystyle{ ϕ }[/math]、[math]\displaystyle{ f_q }[/math]和[math]\displaystyle{ ϕ^\dagger }[/math]预测的[math]\displaystyle{ x_{t+1} }[/math]接近于[math]\displaystyle{ x_{t+1} }[/math]的实际数据的约束下最大化。它们的关系用方程1表示为:

-

[math]\displaystyle{ \begin{aligned}&\max_{\phi,f_{q},\phi^{+}}\mathcal{J}(f_{q}),\\&s.t.\begin{cases}\parallel\hat{x}_{t+1}-x_{t+1}\parallel\lt \epsilon,\\\hat{x}_{t+1}=\phi^{\dagger}\left(f_{q}(\phi(x_{t})\bigr)\right).\end{cases}\end{aligned} }[/math]

(1)

NIS使用神经网络对方程1中所有需要优化的函数进行参数化,其中粗粒度函数[math]\displaystyle{ ϕ }[/math]和反粗粒度函数[math]\displaystyle{ ϕ^\dagger }[/math]分别称为编码器和解码器,宏观动力学函数fq称为动态学习器。其次考虑到[math]\displaystyle{ ϕ }[/math]和[math]\displaystyle{ ϕ^\dagger }[/math]之间的对称位置,使用采用RealNVP框架的可逆神经网络来降低模型复杂性,并使数学分析成为可能。具体如下:

[math]\displaystyle{ ϕ≡ Proj_q(\psi_\omega) }[/math]

式中,ψω: Rp→Rp是一个参数为ω的可逆神经网络,Projq表示保留前q维以形成宏观状态y的投影运算,去掉后P−q维变量y'。根据经验,y'可以近似地视为高斯噪声并与y独立,或者我们可以通过训练神经网络强制y'成为独立的高斯噪声。同样,在对称情况下,[math]\displaystyle{ ϕ^\dagger }[/math]可以近似为:对于任意输入y∈Rq,

[math]\displaystyle{ \phi^{\dagger}(y)=\psi_{\omega}^{-1}(y\oplus\xi) }[/math]

其中ξ为p−q维的标准高斯随机向量,⊕表示向量拼接操作。

最后,用一种具有权参数的前馈神经网络fq对宏观动力学fθ进行参数化。它的输入和输出层神经元的数量等于宏观状态q的维数。它有两个隐藏层,每层有64个神经元,输出使用LeakyReLU进行转换。为了计算EI,我们将这个前馈神经网络看作一个高斯分布,它对条件概率p(yt+1|yt)进行建模。当神经网络收敛时,yt与yt+1之间的互信息近似于xt与xt+1之间的互信息,因此需要方程1中的约束。

具体来说,模型输入是微观状态[math]\displaystyle{ X_t\ (X_t^1,X_t^2,…,X_t^p ) }[/math],[math]\displaystyle{ p }[/math]表示输入数据的维数,输出预测下一个时刻的微观状态[math]\displaystyle{ \hat{X}_{t+1}\left(\hat{X}_{t+1}^1, \hat{X}_{t+1}^2, \ldots, \hat{X}_{t+1}^p\right) }[/math],该方法的目标函数是希望保证微观状态预测误差很小的条件下最大化有效信息,在保证预测误差约束足够小的情况下,NIS方法可以避免trivial解的出现。

具体计算公式如下所示:

[math]\displaystyle{ \max_{\phi_q,\hat{f}_{\phi_q},\phi_q^†,q} \mathcal{I}(\hat{f}_{\phi_q}) }[/math]

[math]\displaystyle{ \text{s.t.}\left\|\phi_q^{\dagger}(Y(t+1))-X_{t+1}\right\|\lt \epsilon }[/math]

最终希望得到有效的粗粒化维度[math]\displaystyle{ q }[/math]、粗粒化策略[math]\displaystyle{ \mathrm{\phi}_q }[/math]和宏观动力学[math]\displaystyle{ {\hat{f}}_{\mathrm{\phi}_q} }[/math]。

概述

NIS的缺陷

泛函...

强化版神经信息压缩机(NIS+)

为了最大化方程1中定义的EI,我们将NIS的框架扩展为NIS+。在NIS+中,我们首先使用互信息和变分不等式的公式将互信息的最大化问题转化为机器学习问题,其次,我们引入神经网络gθ'来学习逆宏观动力学,即使用yt+1 = ϕ (xt+1)来预测yt,从而保证互信息最大化。最后,利用概率重加权技术解决均匀分布的计算干预的挑战,从而优化EI。所有这些技术组成了增强版神经信息压缩机(NIS+)。

形式上,由方程1定义的不等式约束下的最大化问题可转化为无约束的损失函数最小化问题,即:

[math]\displaystyle{ \min_{f,g,\phi,\phi\dagger}\sum_{t=1}^{T-1}w(\boldsymbol{x}_t)||\boldsymbol{y}_t-g(\boldsymbol{y}_{t+1})||+\lambda||\hat{x}_{t+1}-\boldsymbol{x}_{t+1}|| }[/math]

式中,ω, θ, θ′分别为神经网络的参数,分别为ψω, fθ, gθ′。yt=ϕ(xt) = Projq(ψω(xt))和yt+1=ϕ(xt+1) = Projq(ψω(xt+1)宏观状态。λ是拉格朗日乘子,在实验中将作为超参数。ω(xt)为逆概率权值,定义为:

[math]\displaystyle{ w(\boldsymbol{x}_t)=\frac{\tilde{p}(\boldsymbol{y}_t)}{p(\boldsymbol{y}_t)}=\frac{\tilde{p}(\phi(\boldsymbol{x}_t))}{p(\phi(\boldsymbol{x}_t))} }[/math]

其中,p为do(yt ~ Uq)干预后宏观状态yt的新分布,p为数据的自然分布。在实践中,p(yt)是通过核密度估计(KDE)来估计的。我们假设近似分布p (yt)是均匀分布,其特征为一个常数。因此,权重ω被计算为这两个分布的比值。

概述

数学推导

问题的形式化表达

宏观EI的变分下界

编码器的通用逼近定理

机器学习算法

样本重加权

反向动力学

分阶段训练

面对大规模复杂系统的拓展

NIS 和NIS+ 的原理图

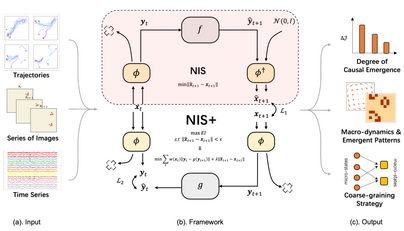

(a)输入端:模拟系统的各种形式的数据,如Boid群集模型(多智能体系统),康威生命游戏(二维细胞自动机)和真实的大脑fMRI时间序列数据。(b) 分析框架:NIS+的框架,它结合了以前的模型NIS。方框表示函数或神经网络,指向叉的箭头表示信息屏蔽操作。其中xt和xt+1表示微观状态的观测数据,x t+1表示预测的微观状态。通过编码器对微观状态进行编码,得到宏观状态,表示为yt = ϕ (xt)和yt+1 = ϕ (xt+1)。同样,通过对微观状态的预测进行编码,可以获得预测的宏观状态,yt = ϕ (xt)和yt+1 = ϕ (xt+1)。这种新颖的NIS+计算框架可以实现粗粒度突现空间下EI的最大化。因此,它可以在涌现空间上优化一个由fθ表示的独立因果机制(f)。一旦获得不同q的宏观动力学fθ,它也可以用来量化原始数据中的CE。(c) 输出端:NIS+的各种输出形式,包括CE的程度、学习到的宏观动态、捕捉到的涌现模式和粗粒度策略。

在实践中,通过在训练数据上设置归一化MAE(平均绝对误差除以x的标准差)来获得λ的值。标准化MAE的选择确保了不同实验的一致标准,考虑到不同的数值范围。通过改变q,我们可以得到不同维度的宏观动力学。如果q = p,那么fp就是学习到的微动力学。然后我们可以对任意q进行Jq和Jp的比较。因果涌现的量化计算以下差值:∆J ≡ J (fq) − J (fp), 其中∆J定义为因果涌现的程度。如果∆J > 0,则数据内存在因果涌现。

NIS+ 框架有效性的验证(数值实验)

SIR模型实验

在这个实验中,SIR(易感、感染、恢复或死亡)模型是一个简单的宏观动态系统,而微观变量则是通过在宏观变量中引入噪声产生的。主要目的是评估我们的模型是否能够有效地去除噪声、发现有意义的宏观动态、识别CE,并展示超越训练数据集分布的泛化能力。

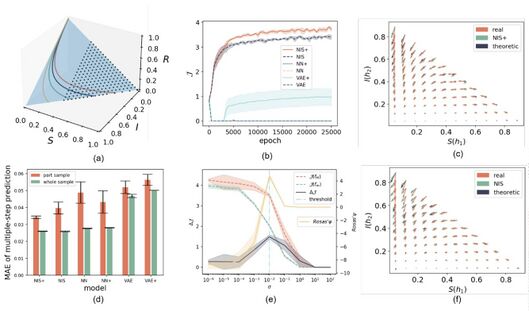

(a) SIR模型的相空间,以及具有相同感染率和恢复率或死亡率的四个示例轨迹。同时显示用于训练的完整数据集(蓝色区域)和部分数据集(虚线区域),分别由63,000和42,000个均匀分布的数据点组成。(b)曲线描述了不同模型的维平均有效信息(J)随训练时间的变化。线表示平均值,而带宽表示五次重复实验的标准差。(c)比较了SIR动力学的矢量场、NIS+的习得宏观动力学和习得编码器的雅可比矩阵变换后的宏观动力学。每个箭头代表一个方向,以及在该坐标点的动力学导数的大小。(d)将整体与局部进行比较,以评估在部分数据集(缺失42,000个数据点)或完整数据集上训练的不同模型的多步预测误差。这些模型包括NIS+、NIS、前馈神经网络(NN)、具有逆概率加权和反向动力学学习技术的前馈神经网络(NN+)、变分自编码器(VAE)及其重加权和反向动力学版本(VAE+)。(e).微观动力学(J (fm))和宏观动力学(J (fm))的CE(∆J)和EI的变化绘制为观测噪声变化的标准差σ。所有这些指标都是跨维度平均的。按照Rosas对CE的定义和计算方法,黄线表示Rosas ' Ψ的变化。垂直线表示归一化MAE的阈值为0.3。当σ大于阈值时,则不符合式1的误差约束,结果不可靠。(f)将SIR动力学的矢量场、NIS的习得宏观动力学和NIS的编码器雅可比矩阵变换后的宏观动力学与(c)进行比较。

比率导致观察到CE的发生。然而,当Rosas的Ψ < 0时,我们不能做出明确的判断,因为Ψ只能为CE提供充分条件。这两个指标在σ = 10−2处达到峰值,这与我们模拟中使用的时间步长(dt = 0.01)的大小相对应,反映了微观状态的变化水平。另一方面,如果噪声过大,有限的观测数据将使NIS+难以从数据中准确识别正确的宏观动力学。因此,CE的∆J的程度降至零。虽然NIS+判定σ > 10时不存在CE,但这一结果并不可靠,因为σ = 10−2后的归一化预测误差已经超过了所选阈值0.3(垂直虚线和虚线)。

因此,这些实验表明,通过最大化EI和学习独立的因果机制,NIS+可以有效地忽略数据中的噪声,准确地学习真实宏观动态,并泛化到未见数据。此外,NIS+在量化CE方面表现出优越的性能。

Boids 模型实验

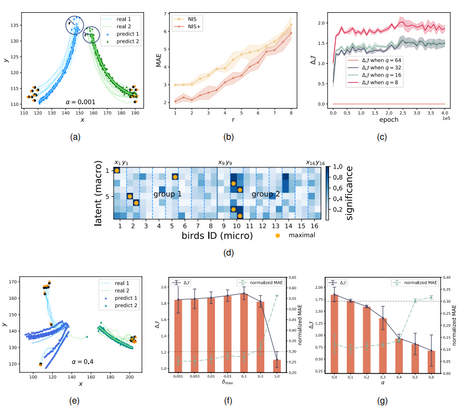

Boids模型是一个著名的模拟鸟类集体行为的多代理模型,在这个实验中测试了NIS+ 在具有内在和外在噪声的不同环境中识别突发集体行为和CE 量化的能力。为了提高训练粗粒度策略的可解释性,将尝试在学习到的宏观状态和微观状态之间给出明确的对应关系。在300×300画布上使用N = 16个boids进行模拟以生成训练数据。为了评估NIS+发现有意义的宏观状态的能力,我们将所有boids分为两组,并人为地修改boids模型,为每组引入不同的恒定转向力。这种修改确保了两组具有不同转弯角度的独立轨迹。每个物体在每个时间步长的微观状态包括它们的水平和垂直位置,以及它们的二维速度。所有生物的微观状态形成一个4N维实数向量,作为训练NIS+的输入。

上图为NIS+学习Boids模型的集体群集行为的实验结果。(a)和(e)给出了各种条件下星体轨迹的实际和预测数据。具体来说,他们给出了在两个分离组和随机偏转角度条件下的多步(50步)预测的比较结果。它们的本征噪声水平α分别为0.001和0.4。(b)展示了多步预测的平均绝对误差(MAE)的上升,因为半径r(表示(a)中物体的初始位置范围)超出了训练数据的限制。(c)用不同的q超参数(代表不同宏观状态的尺度)描述了NIS+的训练时代中维度平均因果出现(∆J)的变化趋势。(d)为显著性图,直观地描述了每个宏观维度与每个体的空间坐标之间的关联。我们用橙色点突出了每个宏观状态维度中最重要的对应微观状态,这些微观状态是使用应用于模型的积分梯度(IG)方法确定的。横轴表示16个物体在微观状态下的x和y坐标,纵轴表示8个宏观维度。淡蓝色的虚线区分了不同个体体的坐标,而钢蓝色的实线分隔了实体组。

(f)和(g)表示不同噪声水平下∆J和归一化MAE的变化,(f)表示外部噪声(观测,加入微观状态)(δmax), (g)表示本征噪声(α,通过修改Boids模型的动力学规则加入)。在(f)和(g)中,水平线表示违反式1中误差约束的阈值。当归一化MAE大于阈值0.3时,违反约束,结果不可靠。

NIS+可以通过最大化EI来学习最优宏观动态和粗粒度策略。这种最大化增强了它对超出训练数据范围的情况的泛化能力。学习到的宏观状态有效地识别了平均群体行为,并且可以使用IG方法将其归因于个体位置。此外,CE的程度随外在噪声的增加而增加,而随内在噪声的减少而减少。这一观察结果表明,通过粗粒化可以消除外在噪声,而内在噪声则不能。

生命游戏模型实验

大脑fMRI 时间序列数据模型实验

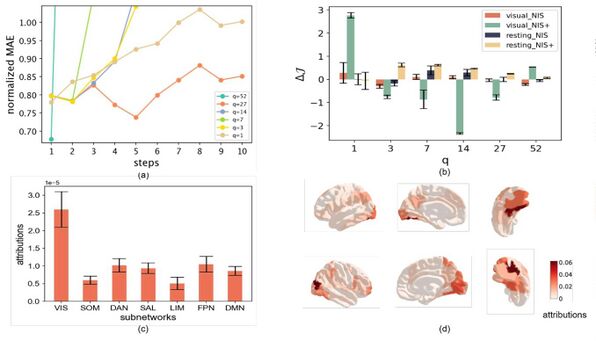

本实验在830名受试者的真实大脑fMRI时间序列数据上测试了NIS+模型。fMRI扫描数据是在受试者观看同一段电影时收集的。因此,在相似的自然刺激下,被试的相似经历是预期的,这对应于具有不同初始条件的相同动力学的时间序列。通过Schaefer atlas方法对原始数据进行预处理,将每个受试者的时间序列维数从大约140,000(不同受试者的维数不同)降至100,使NIS+能够运行并获得更清晰的结果。然后,选取前800个时间序列数据进行训练,剩下的30个时间序列进行测试。将结果与另一个fMRI数据集进行了比较,其中50名受试者处于静息状态。

上图为学习结果、因果涌现程度以及NIS+和NIS对大脑fMRI数据的归因分析。(a)在测试数据集上不同尺度(q)下,多步预测的平均误差随预测步长增加而增加。(b)比较不同模型和不同数据集(包括观影fMRI(视觉fMRI)和静息fMRI)的CE测量值(平均维度,∆J)。柱状图为10次重复实验的平均结果,误差柱状图为标准差。(c)给出了各子网络在Schaefer Atlas下的平均属性,采用积分梯度(IG)分析方法在编码器上以q = 1的尺度计算。误差条表示标准误差。(d)显示观影(视觉)fMRI数据的归因图。

为了证明NIS+对微观状态的预测能力,图(a)展示了在不同的超参数q下,归一化后的MAE随着微动力学对测试数据的预测步骤的变化。显然,当q = 27和q = 1时,NIS+的预测效果更好。具体来说,随着预测步骤的增加,与q = 1的曲线相比,q = 27的曲线显示出较慢的增长率。这表明选择超参数q为27可能比选择1更合适。然而,图(b)显示了不同的结果。当比较不同超参数q(绿色条)的CE(∆J)程度时,当q = 1时观察到最高的∆J。反之,当q = 27时,∆J值为负。这表明,当q = 27时,预测结果的改善可能归因于过拟合。因此,就∆J而言,q = 1优于q的其他值。尽管观察到q = 1时∆J的标准差较大,但NIS框架(红色条形图)支持了这一发现。此外,我们还将CE的结果与静息数据进行了比较,观察到NIS(深蓝色条)和NIS+(黄色条)在q = 7处达到峰值,这正好是Schaefer atalas中子系统的数量。因此,我们可以得出结论,当受试者看电影时,不同大脑区域的活动可以在每个时间步上用一个实数来表示。

为了研究NIS+粗粒度如何将输入数据转化为单维宏观状态,我们还利用IG方法来识别微观状态的最重要维度。结果如图 (c)和(d)所示。我们观察到视觉(VIS)子网络表现出最高的归因(图(c))。这些视觉子网络代表了受试者在观看电影片段时使用的功能系统。此外,我们可以在大脑地图上更详细地看到活动区域(图(d)),其中较深的颜色表示更大程度上归因于单一宏观状态。因此,NIS+识别出的具有相似最深颜色的区域,对应于大脑的深度视觉处理区域,可能代表了大脑在积极观看电影时的“协同核心”。这些区域的数字神经元可能协作并共同起作用。然而,通过将微观状态和宏观状态之间的相互信息分解为协同信息、冗余信息和唯一信息,还可以进一步证实和量化这一结论。 综上所述,NIS+展示了其学习和粗化来自大脑的复杂fMRI信号的能力,允许使用单个宏观状态模拟复杂的动态。这一发现揭示了电影观看过程中复杂的神经活动可以被一维宏观状态编码,主要集中在视觉(VIS)子网络内的区域。

总结与展望

NIS+框架的显著特征是,它专注于在保持有效性约束的同时最大化学习宏观动力学的有效信息(EI)。这使得学习到的涌现宏观动力学能够识别尽可能独立于输入数据分布的不变因果机制。这个特性不仅使NIS+能够识别不同环境中的数据CE,而且还增强了它对不同于训练数据的环境进行泛化的能力。因此,NIS+扩展了Hoel的CE理论,使其既适用于离散和连续动力系统,也适用于实际数据。

上述实验表明,通过最大化EI, NIS+在多步预测和模式捕获等任务中优于其他机器学习模型,即使在训练过程中没有遇到的环境中也是如此。因此,NIS+能够在潜在空间中获得更稳健的宏观动力学。NIS+比Rosas的Ψ指标更能合理地量化CE。NIS+可以有效地学习复杂系统的粗粒度化过程,并使用积分梯度(IG)方法可以将宏观状态和微观状态之间的关系可视化,从而可以识别微观状态中最重要的变量。在大脑实验中,发现存储在唯一宏观状态下的最关键信息与视觉子网络的微观变量表现出很强的相关性。这一发现突出了NIS+识别与有意义的生物学解释相一致的适当的粗粒度策略的能力。

NIS+在气候系统、集体行为、流体动力学、大脑活动和交通流等真实复杂系统的数据驱动建模方面具有各种应用潜力。通过学习更稳健的宏观动力学,这些系统的预测能力可以得到增强。除了动态学习之外,EI最大化方法可以在其他问题领域进一步扩展,如图像分类和自然语言理解。这可以促使诸如图像识别、对象检测、语言理解和机器翻译等任务的进步。

因果涌现与因果表征学习(causal representation learning, CRL)之间的关系。NIS+框架可以看作是CRL的一种形式,其中宏观动态作为因果机制,粗粒度策略作为表示。因此,可以应用CRL中使用的技术来查找数据中的CE。相反,可以在CRL中利用CE和粗粒度的概念来增强模型的可解释性。

NIS+的另一个有趣的优点是它对涌现理论的潜在贡献,它调和了关于涌现是一个客观概念还是一个依赖于观察者的认知概念的争论。通过设计一个最大化EI的机器,可以提取出客观的涌现特征和动态。

NIS+也存在一些局限性,首先,NIS+需要大量的训练数据来学习宏观动态和粗粒度策略,这在很多现实情况下可能是不可行的。如果培训不充分,可能导致CE的错误识别。因此,有必要结合其他数值方法,如Rosas的ΦID,以做出准确的判断。其次,神经网络的可解释性,特别是对于宏观动态学习者来说,仍然是一个难点。最后,当前的框架主要是为马尔可夫动力学设计的,而许多真实的复杂系统表现出长期记忆或涉及不可观察的变量。扩展NIS+框架以适应非马尔可夫动力学是未来研究的一个重要领域,解决这些限制并探索这些改进途径可以让NIS+应用于更广泛的复杂系统的数据分析。