“人工智能”的版本间的差异

(→应用) |

|||

| 第329行: | 第329行: | ||

== 应用 == | == 应用 == | ||

| − | |||

AI与任何智力任务都息息相关。现代AI技术无处不在<ref name=":1">{{Cite book|last=|first=|url=https://ec.europa.eu/info/sites/info/files/commission-white-paper-artificial-intelligence-feb2020_en.pdf|title=White Paper: On Artificial Intelligence - A European approach to excellence and trust|publisher=European Commission|year=2020|isbn=|location=Brussels|pages=1}}</ref> ,数量众多,无法在此列举。通常,当一种技术变成主流应用时,它就不再被认为是AI; 这种现象被称为'''AI效应'''。 | AI与任何智力任务都息息相关。现代AI技术无处不在<ref name=":1">{{Cite book|last=|first=|url=https://ec.europa.eu/info/sites/info/files/commission-white-paper-artificial-intelligence-feb2020_en.pdf|title=White Paper: On Artificial Intelligence - A European approach to excellence and trust|publisher=European Commission|year=2020|isbn=|location=Brussels|pages=1}}</ref> ,数量众多,无法在此列举。通常,当一种技术变成主流应用时,它就不再被认为是AI; 这种现象被称为'''AI效应'''。 | ||

2021年8月8日 (日) 17:32的版本

人工智能 Artificial Intelligence(AI),在机科计算学中亦称机器智能 Machine Intelligence。与人和其他动物表现出的自然智能相反,AI指由人制造出来的机器所表现出来的智能。前沿AI的教科书把AI定义为对智能体的研究:智能体指任何感知周围环境并采取行动以最大化其成功实现目标的机会的机器。[1][2][3][4]通俗来说,“AI”就是机器模仿人类与人类大脑相关的“认知”功能:例如“学习”和“解决问题”。

AI 应用包括高级网络搜索引擎、推荐系统(YouTube、亚马逊和Netflix 使用)、理解人类语音(例如Siri或Alexa)、自动驾驶汽车(例如特斯拉)以及在战略游戏系统中进行最高级别的竞争(例如国际象棋和围棋),[5]随着机器的能力越来越强,被认为需要“智能”的任务往往从人工智能的定义中删除,这种现象被称为人工智能效应。[6]例如,光学字符识别经常被排除在人工智能之外, [7]已成为一项常规技术。[8]

1956年AI作为一门学科被建立起来,后来经历过几段乐观时期[9][10][11][10][12][13][14]与紧随而来的亏损以及缺乏资金的困境(也就是“AI寒冬”[10][12][13][15][14][11]),每次又找到了新的出路,取得了新的成果和新的投资[16]。AI 研究在其一生中尝试并放弃了许多不同的方法,包括模拟大脑、模拟人类问题解决、形式逻辑、大型知识数据库和模仿动物行为。在 21 世纪的头几十年,高度数学的统计机器学习已经主导了该领域,并且该技术已被证明非常成功,有助于解决整个工业界和学术界的许多具有挑战性的问题。[12][17][13][14]

AI 研究的各个子领域都围绕特定目标和特定工具的使用。人工智能研究的传统目标包括推理、知识表示、规划、学习、自然语言处理、感知以及移动和操纵物体的能力。[12] [18][19][20]通用智能(解决任意问题的能力)是该领域的长期目标之一。[21][17]为了解决这些问题,人工智能研究人员使用了各种版本的搜索和数学优化、形式逻辑、人工神经网络以及基于统计的方法,概率和经济学。AI 还借鉴了计算机科学、心理学、语言学、哲学和许多其他领域。

这一领域是建立在人类智能“可以被精确描述从而使机器可以模拟”的观点上的。这一观点引出了关于思维的本质和造具有类人智能AI的伦理方面的哲学争论,于是自古以来[14]就有一些神话、小说以及哲学对此类问题展开过探讨。一些人认为AI的发展不会威胁人类生存;[22][23]但另一些人认为AI与以前的技术革命不同,它将带来大规模失业的风险。[24]

历史

具有思维能力的人造生物在古代以故事讲述者的方式出现,在小说中也很常见。比如 Mary Shelley的《弗兰肯斯坦 Frankenstein 》和 Karel Čapek的《罗素姆的万能机器人 Rossum's Universal Robots,R.U.R.》 [11] ——小说中的角色和他们的命运向人们提出了许多现在在人工智能伦理学中讨论的同样的问题。

机械化或者说“形式化”推理的研究始于古代的哲学家和数学家。这些数理逻辑的研究直接催生了图灵的计算理论,即机器可以通过移动如“0”和“1”的简单的符号,就能模拟任何通过数学推演可以想到的过程,这一观点被称为邱奇-图灵论题 Church–Turing Thesis[25]。图灵提出“如果人类无法区分机器和人类的回应,那么机器可以被认为是“智能的”。[26]目前人们公认的最早的AI工作是由McCullouch和Pitts 在1943年正式设计的图灵完备“人工神经元”。[27]

AI研究于1956年起源于在达特茅斯学院举办的一个研讨会,[11][10] [12][13]其中术语“人工智能”是由约翰麦卡锡创造的,目的是将该领域与控制论区分开来,并摆脱控制论主义者诺伯特维纳的影响。[28]与会者Allen Newell(CMU),赫伯特·西蒙 Herbert Simon(CMU),约翰·麦卡锡 John McCarthy(MIT),马文•明斯基 Marvin Minsky(MIT)和阿瑟·塞缪尔 Arthur Samuel(IBM)成为了AI研究的创始人和领导者。他们和他们的学生做了一个新闻表述为“叹为观止”的计算机学习策略(以及在1959年就被报道达到人类的平均水平之上) ,解决代数应用题,证明逻辑理论以及用英语进行表达。到20世纪60年代中期,美国国防高级研究计划局斥重资支持研究,世界各地纷纷建立研究室。AI的创始人对未来充满乐观: Herbert Simon预测“二十年内,机器将能完成人能做到的一切工作。”。Marvin Minsky对此表示同意,他写道: “在一代人的时间里... ... 创造‘AI’的问题将得到实质性的解决。”

他们没有意识到现存任务的一些困难。研究进程放缓,在1974年,由于ir James Lighthill的指责以及美国国会需要分拨基金给其他有成效的项目,美国和英国政府都削减了探索性AI研究项目。接下来的几年被称为“AI寒冬”,在这一时期AI研究很难得到经费。

在20世纪80年代初期,由于专家系统在商业上取得的成功,AI研究迎来了复兴,[29][12][18][20][11][10][14]专家系统是一种能够模拟人类专家的知识和分析能力的程序。到1985年,AI市场超过了10亿美元。与此同时,日本的第五代计算机项目促使了美国和英国政府恢复对学术研究的资助。然而,随着1987年 Lisp 机器市场的崩溃,AI再一次遭遇低谷,并陷入了第二次持续更长时间的停滞。

人工智能在 1990 年代末和 21 世纪初通过寻找特定问题的具体解决方案,例如物流、数据挖掘或医疗诊断,逐渐恢复了声誉。到 2000 年,人工智能解决方案被广泛应用于幕后。狭窄的焦点使研究人员能够产生可验证的结果,开发更多的数学方法,并与其他领域(如统计学、经济学和数学)合作。[12][11]

更快的计算机、算法改进和对大量数据的访问使机器学习和感知取得进步;数据饥渴的深度学习方法在 2012 年左右开始主导准确性基准。[30]据彭博社的Jack Clark称,2015 年是人工智能具有里程碑意义的一年,谷歌内部使用人工智能的软件项目数量从 2012 年的“零星使用”增加到 2700 多个项目。克拉克还提供了事实数据,表明自 2012 年以来 AI 的改进受到图像处理任务中较低错误率的支持。[31]他将此归因于可负担得起的神经网络的增加,这是由于云计算基础设施的增加以及研究工具和数据集的增加。在 2017 年的一项调查中,五分之一的公司表示他们“在某些产品或流程中加入了人工智能”。[32][33]

目标

模拟(或创造)智能的一般问题已被分解为若干子问题。这些问题中涉及到的特征或能力是研究人员期望智能系统展示的。受到了最多的关注的是下面描述的几个特征。

推理,解决问题

早期的研究人员开发了一种算法,这种算法模仿了人类在解决谜题或进行逻辑推理时所使用的循序渐进的推理。到20世纪80年代末和90年代,AI研究使用概率论和经济学的理论开发出了处理不确定或不完全信息的方法。[12][19][18] [20]

这些算法被证明不足以解决大型推理问题,因为它们经历了一个“组合爆炸” : 随着问题规模变得越来越大,它们的处理效率呈指数级下降。[12]事实上,即使是人类也很少使用早期AI研究建模的逐步推理。人们通过快速、直觉的判断来解决大多数问题。[34]

知识表示

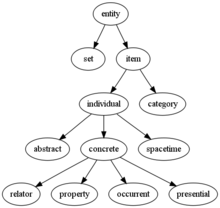

传统的AI研究的重点是知识表示 Knowledge Representation[29][12] [19][18][20]和知识工程 Knowledge Engineering[12][19][20]。有些“专家系统”试图将某一小领域的专家所拥有的知识收集起来。此外,一些项目试图将普通人的“常识”收集到一个包含对世界的认知的知识的大数据库中。这些常识包括:对象、属性、类别和对象之间的关系;[12][19][18][20]情景、事件、状态和时间;[12][19][20]原因和结果;[19]关于知识的知识(我们知道别人知道什么);和许多其他研究较少的领域。“存在的东西”的表示是本体,本体是被正式描述的对象、关系、概念和属性的集合,这样的形式可以让软件智能体能够理解它。本体的语义描述了逻辑概念、角色和个体,通常在Web本体语言中以类、属性和个体的形式实现。[35]最常见的本体称为上本体 Upper Ontology,它试图为所有其他知识提供一个基础,它充当涵盖有关特定知识领域(兴趣领域或关注领域)的特定知识的领域本体之间的中介。这种形式化的知识表示可以用于基于内容的索引和检索,[36]场景解释,[37]临床决策,[38]知识发现(从大型数据库中挖掘“有趣的”和可操作的推论)[39]等领域。[40]

知识表示中最困难的问题是:

默认推理和资格问题 : 人们对事物的认知常常基于一个可行的假设。提到鸟,人们通常会想象一只拳头大小、会唱歌、会飞的动物,但并不是所有鸟类都有这样的特性。1969年John McCarthy[41][42]将其归咎于限定性问题:对于AI研究人员所关心的任何常识性规则来说,大量的例外往往存在。几乎没有什么在抽象逻辑角度是完全真或完全假。AI研究探索了许多解决这个问题的方法。[19][18][20]

常识的广度: 常人掌握的“元常识”的数量是非常大的。试图建立一个完整的常识知识库(例如Cyc)的研究项目需要大量费力的本体工程——它们必须一次手工构建一个复杂的概念。[43][44][45][46]

一些常识性知识的子符号形式: 人们所知道的许多东西必不能用可以口头表达的“事实”或“陈述”描述。例如,一个国际象棋大师会避免下某个位置,因为觉得这步棋“感觉上太激进”;[47]或者一个艺术评论家可以看一眼雕像,就知道它是假的。[48]这些是人类大脑中无意识和亚符号的直觉。这种知识为符号化的、有意识的知识提供信息和语境。[49][50]与子符号推理的相关问题一样,我们希望情境AI、计算智能或统计AI能够表示这类知识。

规划

智能体必须能够设定并实现目标。[29][12][19][18][20]他们需要能够有设想未来的办法——这是一种对其所处环境状况的表述,并能够预测他们的行动将如何改变环境——依此能够选择使效用(或者“价值”)最大化的选项。[12]

在经典的规划问题中,智能体可以假设它是世界上唯一运行着的系统,以便于智能体确定其做出某个行为带来的后果。[51][52]然而,如果智能体不是唯一的参与者,这就要求智能体能够在不确定的情况下进行推理。这需要一智能体不仅能够评估其环境和作出预测,而且还评估其预测和根据其预测做出调整。

多智能体规划利用多个智能体之间的协作和竞争来达到目标。进化算法和群体智能会用到类似这样的涌现行为。[53]

学习

机器学习 Machine Learning(ML)是自AI诞生以来就有的一个基本概念,它研究如何通过经验自动改进计算机算法。[29][12][19][18][20]

无监督学习 Unsupervised Learning可以从数据流中发现某种模式,而不需要人类提前标注数据。监督学习 Supervised Learning包括分类和回归,这需要人类首先标注数据。分类被用于确定某物属于哪个类别,这需要把大量来自多个类别的例子投入程序;回归用来产生一个描述输入和输出之间的关系的函数,并预测输出会如何随着输入的变化而变化[54]。在强化学习[12][18]中,智能体会因为好的回应而受到奖励,因为坏的回应而受到惩罚;智能体通过一系列的奖励和惩罚形成了一个在其问题空间中可施行的策略。

自然语言处理

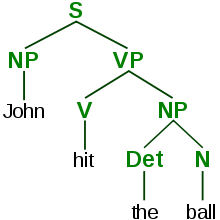

自然语言处理 Natural language processing(NLP)赋予机器阅读和理解人类语言的能力。一个足够强大的自然语言处理系统可以提供自然语言用户界面,并能直接从如新闻专线文本的人类文字中获取知识。一些简单的自然语言处理的应用包括信息检索、文本挖掘、问答和机器翻译。[12][18]目前许多方法使用词的共现频率来构建文本的句法表示。用“关键词定位”策略进行搜索很常见且可扩展,但很粗糙;搜索“狗”可能只匹配与含“狗”字的文档,而漏掉与“犬”匹配的文档。“词汇相关性”策略使用如“事故”这样的词出现的频次,评估文本想表达的情感。现代统计NLP方法可以结合所有这些策略以及其他策略,在以页或段落为单位的处理上获得还能让人接受的准确度,但仍然缺乏对单独的句子进行分类所需的语义理解。除了编码语义常识常见的困难外,现有的语义NLP有时可扩展性太差,无法应用到在商业中。而“叙述性”NLP除了达到语义NLP的功能之外,还想最终能做到充分理解常识推理。[55]到2019年,变压器基于深度学习的架构可以生成连贯的文本。[56]

知觉

机器感知 Machine perception[12][20]是利用传感器(如可见光或红外线摄像头、麦克风、无线信号、激光雷达、声纳、雷达和触觉传感器)的输入来推断世界的不同角度的能力。应用包括语音识别、面部识别和物体识别。[29][12]计算机视觉是分析可视化输入的能力。这种输入通常是模糊的; 一个在远处50米高的巨人可能会与近处正常大小的行人占据完全相同的像素,这就要求AI判断不同解释的相对可能性和合理性,例如使用”物体模型”来判断50米高的巨人其实是不存在的。[20][29][12]

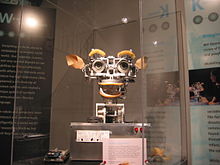

运动和操作

AI在机器人学中应用广泛[29][12][19]。在现代工厂中广泛使用的高级机械臂和其他工业机器人,可以从经验中学习如何在存在摩擦和齿轮滑移的情况下有效地移动。[12]当处在一个静态且可见的小环境中时,现代移动机器人可以很容易地确定自己的位置并绘制环境地图;然而如果是动态环境,比如用内窥镜检查病人呼吸的身体的内部,难度就会更高。运动规划是将一个运动任务分解为如单个的关节运动这样的“基本任务”的过程。这种运动通常包括顺应运动,在这个过程中需要与物体保持物理接触。[57][12][58]莫拉维克悖论 Moravec's Paradox [59]概括了人类理所当然认为低水平的感知运动技能很难在编程给机器人的事实,这个悖论是以汉斯 · 莫拉维克的名字命名的,他在1988年表示: “让计算机在智力测试或下跳棋中展现出成人水平的表现相对容易,但要让计算机拥有一岁小孩的感知和移动能力却很难,甚至不可能。”[60][61]这是因为,身体灵巧性在数百万年的自然选择中一直作为一个直接的目标以增强人类的生存能力;而与此相比,跳棋技能则很奢侈,“擅长跳棋”的基因并不被生存导向的自然选择所偏好与富集。[62]

社会智能

情感计算 Affective computing是一个跨学科交叉领域,包括了识别、解释、处理、模拟人的情感的系统。例如,一些虚拟助手被编程为对话式说话,甚至幽默地开玩笑;它使他们对人类互动的情感动态更加敏感,或者以其他方式促进人机交互。[63]然而,这往往会给幼稚的用户一个不切实际的概念,即现有的计算机代理实际上有多智能。[64]与情感计算相关的一些还算成功的领域有文本情感分析,以及最近的多模态情感分析 Multimodal Affect Analysis [65],多模态情感分析中AI可以做到将录像中被试表现出的情感进行分类。[66]

从长远来看,社交技巧以及对人类情感和博弈论的理解对社会智能体的价值很高。能够通过理解他人的动机和情绪状态来预测他人的行为,会让智能体做出更好的决策。有些计算机系统模仿人类的情感和表情,有利于对人类交互的情感动力学更敏感,或利于促进人机交互。[67]

通用智能

历史上,诸如 Cyc 知识库和大规模的日本第五代计算机系统倡议(1982-1992)等项目试图涵盖人类的所有认知。这些早期的项目未能逃脱非定量符号逻辑模型的限制,现在回过头看,这些项目大大低估了实现跨领域AI的难度。当下绝大多数AI研究人员主要研究易于处理的“狭义AI”应用(如医疗诊断或汽车导航)[68]。许多研究人员预测,不同领域的“狭义AI”工作最终将被整合到一台具有人工通用智能(AGI)的机器中,结合上文提到的大多数狭义功能,甚至在某种程度上在大多数或所有这些领域都超过人类。[21][17][69]通用人工智能(或“AGI”)子领域专门研究通用智能。[70]

方法

在其历史的大部分时间里,没有既定的统一理论或范式指导人工智能研究。AI 研究分为相互竞争的子领域,这些子领域经常无法相互交流。[71]其中一些子领域基于技术考虑,例如特定目标(例如“机器人”或“机器学习”)、[12][18][19][20]特定工具的使用(“逻辑”或人工神经网络)或社交因素(例如特定机构或研究人员),但它们也来自深刻的哲学差异,导致了非常不同的人工智能方法。

统计机器学习在 2010 年代取得的空前成功使所有其他方法黯然失色,以至于某些来源(尤其是在商业领域)使用术语“人工智能”来表示“使用神经网络进行机器学习”。然而,历史上划分 AI 研究的问题仍未得到解答,未来的研究可能需要重新审视。[72][73]一些最长期悬而未决的问题是:

人工智能是否应该通过研究心理学或神经生物学来模拟自然智能?还是人类生物学与人工智能研究无关,就像鸟类生物学与航空工程一样?

可以使用简单、优雅的原则(例如逻辑或优化)来描述智能行为吗?或者它是否一定需要解决大量不相关的问题?

我们能否编写程序来为给定问题找到可证明正确的解决方案(例如,使用符号逻辑和知识)?还是我们使用的算法只能给我们一个“合理”的解决方案(例如,概率方法),但可能会陷入人类直觉所犯的那种难以理解的错误?[72]

AI 是否应该直接追求人工智能和超级智能的目标?或者最好解决尽可能多的具体问题,并希望这些解决方案能够间接实现该领域的长期目标?[69]

控制论与大脑模拟

在20世纪四五十年代,许多研究人员探索了神经生物学、信息论和控制论之间的联系。他们中的一些人利用电子网络制造机器来表现基本的智能,比如 W·格雷·沃尔特 W. Grey Walter的乌龟和约翰·霍普金斯 Johns Hopkins的野兽。这些研究人员中的许多人参加了在普林斯顿大学的目的论学社和英格兰的比率俱乐部举办的集会[11] [10][12]。到了1960年,这种方法基本上被放弃了,直到二十世纪八十年代一些部分又被重新使用。

符号化方法

当 1950 年代中期可以使用数字计算机时,人工智能研究开始探索将人类智能简化为符号操作的可能性。该研究集中在三个机构进行:卡内基梅隆大学、斯坦福大学和麻省理工学院,如下所述,每个机构都发展了自己的研究风格。John Haugeland将这些象征性的人工智能方法命名为“优秀的老式人工智能”或“ GOFAI ”。[74]在 1960 年代,符号方法在小型演示程序中模拟高级“思维”方面取得了巨大成功,到 1980 年代,它在专家系统方面取得了巨大成功。基于控制论或人工神经网络的方法被放弃或推到了后台。1960 年代和 1970 年代的研究人员确信,符号方法最终会成功地创造出具有通用人工智能的机器,并认为这是他们领域的目标。

模拟认知的方法

经济学家Herbert A. Simon和Allen Newell研究了人类解决问题的技能,并试图将其形式化。他们的工作为AI、认知科学、运筹学和管理科学奠定了基础。他们的研究团队利用心理学实验的结果来开发程序,模拟人们用来解决问题的方法。以卡内基梅隆大学为中心,这种研究传统最终在20世纪80年代中期的SOAR架构开发过程中达到顶峰。

基于逻辑的方法

与Simon和Newell不同,John McCarthy认为机器不需要模拟人类的思维,而是应该尝试寻找抽象推理和解决问题的本质,不管人们是否使用相同的算法。他在斯坦福大学的实验室(SAIL)致力于使用形式逻辑来解决各种各样的问题,包括知识表示、规划和学习。逻辑也是爱丁堡大学和欧洲其他地方工作的重点,这促进了编程语言 Prolog 和逻辑编程科学的发展。

反逻辑的或“邋遢”的方法

麻省理工学院(MIT)的研究人员Marvin Minsky和Seymour Papert等发现,视觉和自然语言处理中的难题需要特定的解决方案——他们认为,没有简单而普遍的原则(如逻辑)可以涵盖智能行为。罗杰•尚克将他们的“反逻辑”方法形容为“邋遢的”(相对于卡内基梅隆大学和斯坦福大学的“整洁”范式)。常识库(如常识知识库的 Cyc)是“邋遢”AI的一个例子,因为它们必须人工一个一个地构建复杂概念。

基于知识的方法

1970年左右,当拥有大容量存储器的计算机出现时,来自这三个研究方向的研究人员开始将知识应用于AI领域。这一轮“知识革命”的一大成果是开发和部署专家系统,第一个真正成功的AI软件。所有专家系统的一个关键部件是存储着事实和规则的知识库[75]。推动知识革命的另一个原因是人们认识到,许多简单的AI应用程序也需要大量的知识。

亚符号方法

到了20世纪80年代,符号AI的进步似乎停滞不前,许多人认为符号系统永远无法模仿人类认知的所有过程,尤其在感知、机器人学、学习和模式识别等方面。许多研究人员开始研究针对特定AI问题的“亚符号”方法。亚符号方法能在没有特定知识表示的情况下,做到接近智能。

具身智慧

具身智慧 Embodied Intelligence包括具体化的、情境化的、基于行为的新式 AI。来自机器人相关领域的研究人员,如Rodney Brooks,放弃了符号化AI的方法,而专注于使机器人能够移动和生存的基本工程问题。他们的工作重启了20世纪50年代早期控制论研究者的非符号观点,并将控制论重新引入到AI的应用中。这与认知科学相关领域的具身理论的发展相吻合: 认为如运动、感知和视觉等身体的各个功能是高智能所必需的。

在发展型机器人中,人们开发了发展型学习方法,通过自主的自我探索、与人类教师的社会互动,以及使用主动学习、成熟、协同运动等指导机制 ,使机器人积累新技能的能力。

计算智能与软计算

上世纪80年代中期,David Rumelhart等人重新激发了人们对神经网络和“连接主义 Connectionism”的兴趣。人工神经网络是软计算的一个例子——它们解决不能完全用逻辑确定性地解决,但常常只需要近似解的问题。AI的其他软计算方法包括模糊系统 Fuzzy Systems 、灰度系统理论 Grey System Theory、演化计算 Evolutionary Computation 和许多统计工具。软计算在AI中的应用是计算智能这一新兴学科的集中研究领域。

统计学习

许多传统的 GOFAI 在实验模型中行之有效,但不能推广到现实世界,陷入了需要不断给符号计算修补漏洞的困境中。然而,在20世纪90年代前后,AI研究人员采用了复杂的数学工具,如隐马尔可夫模型 Hidden Markov Model(HMM)、信息论和标准贝叶斯决策理论 Normative Bayesian Decision Theory来比较或统一各种互相竞争的架构。共通的数学语言允许其与数学、经济学或运筹学等更成熟的领域进行高层次的融合。与 GOFAI 相比,隐马尔可夫模型和神经网络等新的“统计学习”技术在数据挖掘等许多实际领域中不必理解数据集的语义,却能得到更高的精度,随着现实世界数据的日益增加,人们越来越注重用不同的方法测试相同的数据,并进行比较,看哪种方法在比特殊实验室环境更广泛的背景下表现得更好; AI研究正变得更加科学。如今,实验结果一般是严格可测的,有时可以重现(但有难度)[12][11][76] 。不同的统计学习技术有不同的局限性,例如,基本的 HMM 不能为自然语言的无限可能的组合建模。评论者们指出,从 GOFAI 到统计学习的转变也经常是可解释AI的转变。在 通用人工智能 的研究中,[77]一些学者警告不要过度依赖统计学习,并认为继续研究 GOFAI 仍然是实现通用智能的必要条件。[72][73]

集成各种方法

智能主体范式: 智能主体是一个感知其环境并采取行动,最大限度地提高其成功机会的系统。最简单的智能主体是解决特定问题的程序,更复杂的智能主体包括人类和人类组织(如公司)。这种范式使得研究人员能通过观察哪一个智能主体能最大化给定的“目标函数”,直接比较甚至结合不同的方法来解决孤立的问题。解决特定问题的智能主体可以使用任何有效的方法——可以是是符号化和逻辑化的,也可以是亚符号化的人工神经网络,还可以是新的方法。这种范式还为研究人员提供了一种与其他领域(如决策理论和经济学)进行交流的共同语言,因为这些领域也使用了抽象智能主体的概念。建立一个完整的智能主体需要研究人员解决现实的整合协调问题; 例如,由于传感系统提供关于环境的信息不确定,决策系统就必须在不确定性的条件下运作。智能体范式在20世纪90年代被广泛接受。

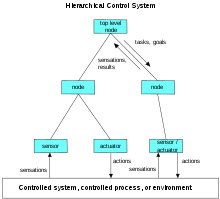

智能主体体系结构和认知体系结构: 研究人员已经设计了一些在多智能体系统中利用相互作用的智能体构建智能系统的系统。分层控制系统为亚符号AI、反应层和符号AI提供了一座桥梁,亚符号AI在底层、反应层和符号AI在顶层。一些认知架构是人为构造用来解决特定问题的;其他比如SOAR,是用来模仿人类的认知,向通用智能更进一步。现在SOAR的扩展是含有符号和亚符号部分的混合智能系统。[78][79][80]

工具

AI领域已经开发出许多工具来解决计算机科学中最困难的问题。下面将讨论其中一些最常用的方法。

搜索和优化

AI中的许多问题可以通过智能地搜索许多可能的解决方案而在理论上得到解决: 推理可以简化为执行一次搜索。例如,逻辑证明可以看作是寻找一条从前提到结论的路径,其中每一步都用到了推理规则。规划算法通过搜索目标和子目标的树,试图找到一条通往目标的路径,这个过程称为“目的-手段”分析。机器人学中移动肢体和抓取物体的算法使用的是位形空间的局部搜索。许多学习算法也使用到了基于优化的搜索算法。[12][19][18][20]

对于大多数真实世界的问题,简单的穷举搜索很难满足要求: 搜索空间(要搜索的位置数)很快就会增加到天文数字。结果就是搜索速度太慢或者永远不能完成。对于许多问题,解决方法是使用“启发式 Heuristics ”或“经验法则 Rules of Thumb ” ,优先考虑那些更有可能达到目标的选择,并且在较短的步骤内完成。在一些搜索方法中,启发式方法还可以完全移去一些不可能通向目标的选择(称为“修剪搜索树”)。启发式为程序提供了解决方案所在路径的“最佳猜测”。[12][19][18][20]启发式把搜索限制在了更小的样本规模里。[57]

在20世纪90年代,一种非常不同的基于数学最优化理论的搜索引起了人们的注意。对于许多问题,可以从某种形式的猜测开始搜索,然后逐步细化猜测,直到无法进行更多的细化。这些算法可以喻为盲目地爬山: 我们从地形上的一个随机点开始搜索,然后,通过跳跃或登爬,我们把猜测点继续向山上移动,直到我们到达山顶。其他的优化算法有 模拟退火算法 、定向搜索 和随机优化 。[12][19][18]

演化计算用到了优化搜索的形式。例如,他们可能从一群有机体(猜测)开始,然后让它们变异和重组,选择适者继续生存(改进猜测)。经典的演化算法包括遗传算法、基因表达编程和遗传编程。[18][20][81][82][83]或者,分布式搜索过程可以通过群智能算法进行协调。搜索中使用的两种流行的群算法是粒子群优化(禽流启发植绒和)蚁群优化(灵感来源于蚂蚁小径)。[84]

逻辑

逻辑[85]被用来表示知识和解决问题,还可以应用到其他问题上。例如,satplan 算法就使用逻辑进行规划。另外,归纳逻辑编程是一种学习方法。

AI研究中使用了多种不同形式的逻辑。命题逻辑包含诸如“或”和“否”这样的真值函数。一阶逻辑[85]增加了量词和谓词,可以表达关于对象、对象属性和对象之间的关系。模糊集合论给诸如“爱丽丝老了”(或是富有的、高的、饥饿的)这样模糊的表述赋予了一个“真实程度”(介于0到1之间),这些表述在语言上很模糊,不能完全判定为正确或错误。模糊逻辑在控制系统中得到了成功应用,使专家能够制定模糊规则,比如“如果你正以较快的速度接近终点站,那么就增加列车的制动压力”;这些模糊的规则可以在系统内用数值细化。但是,模糊逻辑无助于扩展知识库,许多AI研究者质疑把模糊逻辑和推理结合起来的有效性。[86][87]

缺省逻辑 Default Logics、非单调逻辑 Non-monotonic Logics、限制逻辑 Circumscription和模态逻辑 Modal Logics,都用逻辑形式来解决缺省推理和限定问题。一些逻辑扩展被用于处理特定的知识领域,例如:描述逻辑 Description Logics 、情景演算、事件演算、流态演算 Fluent Calculus(用于表示事件和时间)、因果演算、信念演算(信念修正)[88]、和模态逻辑。人们也设计了对多主体系统中出现的矛盾或不一致陈述进行建模的逻辑,如次协调逻辑。

不确定推理的概率方法

AI中的许多问题(在推理、规划、学习、感知和机器人技术方面)要求主体在信息不完整或不确定的情况下进行操作。AI研究人员从概率论和经济学的角度设计了许多强大的工具来解决这些问题。[85]

贝叶斯网络 Bayesian Networks 是一个非常通用的工具,可用于各种问题: 推理(使用贝叶斯推断算法) ,学习(使用期望最大化算法) ,规划(使用决策网络)和感知(使用动态贝叶斯网络)。概率算法也可以用于滤波、预测、平滑和解释数据流,帮助传感系统分析随时间发生的过程(例如,隐马尔可夫模型或卡尔曼滤波器 Kalman Filters)。与符号逻辑相比,形式化的贝叶斯推断逻辑运算量很大。为了使推理易于处理,大多数观察值必须彼此条件独立。含有菱形或其他“圈”(无向循环)的复杂图形可能需要比如马尔科夫-蒙特卡罗图的复杂方法,这种方法将一组随机行走遍布整个贝叶斯网络,并试图收敛到对条件概率的评估。贝叶斯网络在 Xbox Live 上被用来评估和匹配玩家:胜率是证明一个玩家有多有优秀的“证据”。AdSense使用一个有超过3亿条边的贝叶斯网络来学习如何推送广告的。[89]

经济学中的一个关键概念是“效用” :这是一种衡量某物对于一个智能主体的价值的方法。人们运用决策理论、决策分析和信息价值理论开发出了精确的数学工具来分析智能主体应该如何选择和计划。这些工具包括马尔可夫决策过程、动态决策网络、博弈论和机制设计等模型。

分类器与统计学习方法

最简单的AI应用程序可以分为两类: 分类器 Classifiers (“若闪光,则为钻石”)和控制器 Controllers (“若闪光,则捡起来”)。然而,控制器在推断前也对条件进行分类,因此分类构成了许多AI系统的核心部分。分类器一组是使用匹配模式来判断最接近的匹配的函数。它们可以根据样例进行性能调优,使它们在AI应用中更有效。这些样例被称为“观察”或“模式”。在监督学习中,每个模式都属于某个预定义的类别。可以把一个类看作是一个必须做出的决定。所有的样例和它们的对应的类别标签被称为数据集。当接收一个新样例时,它会被分类器根据以前的经验进行分类。

分类器可以通过多种方式进行训练;,比如许多统计学和机器学习方法。决策树可能是应用最广泛的机器学习算法。[89]其他使用广泛的分类器还有神经网络、K最近邻算法、核方法(比如支持向量机)、 高斯混合模型 Gaussian Mixture Mode,以及非常流行的朴素贝叶斯分类器 Naive Bayes Classifier。分类器的分类效果在很大程度上取决于待分类数据的特征,如数据集的大小、样本跨类别的分布、维数和噪声水平。如果假设的模型很符合实际数据,则基于这种模型的分类器就能给出很好的结果。否则,传统观点认为如果没有匹配模型可用,而且只关心准确性(而不是速度或可扩展性) ,在大多数实际数据集上鉴别分类器(尤其是支持向量机)往往比基于模型的分类器(如“朴素贝叶斯”)更准确。[90][91]

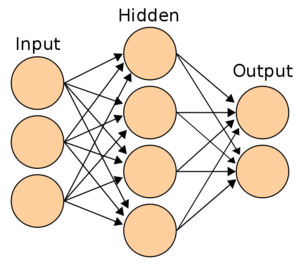

人工神经网络

神经网络的诞生受到人脑神经元结构的启发。一个简单的“神经元”N 接受来自其他神经元的输入,每个神经元在被激活(或者说“放电”)时,都会对N是否应该被激活按一定的权重赋上值。学习的过程需要一个根据训练数据调整这些权重的算法:一个被称为“相互放电,彼此联系”简单的算法在一个神经元激活触发另一个神经元的激活时增加两个连接神经元之间的权重。神经网络中形成一种分布在一个共享的神经元子网络中的“概念”,这些神经元往往一起放电。“腿”的概念可能和“脚”概念的子网络相结合,后者包括”脚”的发音。神经元有一个连续的激活频谱; 此外,神经元还可以用非线性的方式处理输入,而不是简单地加权求和。现代神经网络可以学习连续函数甚至的数字逻辑运算。神经网络早期的成功包括预测股票市场和自动驾驶汽车(1995年)。[89]2010年代,神经网络使用深度学习取得巨大进步,也因此将AI推向了公众视野里,并促使企业对AI投资急速增加; 例如2017年与AI相关的并购交易规模是2015年的25倍多。[92][93]

Walter Pitts和Warren McCullouch共同完成的非学习型人工神经网络的研究比AI研究领域成立早十年。他们发明了感知机 Perceptron,这是一个单层的学习网络,类似于线性回归的概念。早期的先驱者还包括 Alexey Grigorevich Ivakhnenko,Teuvo Kohonen,Stephen Grossberg,Kunihiko Fukushima,Christoph von der Malsburg,David Willshaw,Shun-Ichi Amari,Bernard Widrow,John Hopfield,Eduardo r. Caianiello 等人。

网络主要分为非循环或前馈神经网络 Acyclic or Feedforward Neural Networks(信号只向一个方向传递)和循环神经网络 Recurrent Neural Network(允许反馈和对以前的输入事件进行短期记忆)。其中最常用的前馈网络有感知机、多层感知机 Multi-layer Perceptrons 和径向基网络 Radial Basis Networks。使用赫布型学习 Hebbian Learning (“相互放电,共同链接”) ,GMDH 或竞争学习等技术的神经网络可以被应用于智能控制(机器人)或学习问题。

当下神经网络常用反向传播算法 来训练,1970年反向传播算法出现,被认为是 Seppo Linnainmaa提出的自动微分的反向模式出现[94][95],被Paul Werbos引入神经网络。[96][97]

层次化暂时性记忆是一种模拟大脑新皮层结构和算法特性的方法。[98]

总之,大多数神经网络都会在人工神经拓扑结构上使用某种形式的梯度下降法 Gradient Descent。然而,一些研究组,比如 Uber的,认为通过简单的神经进化改变新神经网络拓扑结构和神经元间的权重可能比复杂的梯度下降法更适用[citation needed]。神经进化的一个优势是,它不容易陷入“死胡同”。[99]

深层前馈神经网络

深度学习是任何可以学习长因果链的人工神经网络。例如,一个具有六个隐藏层的前馈网络可以学习有七个链接的因果链(六个隐藏层 + 一个输出层) ,并且具深度为7的“信用分配路径 Credit Assignment Path(CAP) ”。许多深度学习系统需要学习长度在十及以上的因果链。[100][101][102]

根据一篇综述[103],“深度学习”这种表述是在1986年[104]被Rina Dechter特引入到机器学习领域的,并在2000年Igor Aizenberg和他的同事将其引入人工神经网络后获得了关注。[105] Alexey Grigorevich Ivakhnenko 和 V. G. Lapa 于 1965 年发表了第一个功能性深度学习网络。[106]

第一个可以用的深度学习网络是由A. G.伊瓦赫年科和V.G.拉帕 在1965年发表的。这些网络每次只训练一层。1971年伊瓦赫年科的论文描述了一个8层的深度前馈多层感知机网络的学习过程,这个网络已经比许多后来的网络要深得多了[107]。2006年,杰弗里•辛顿和特迪诺夫的文章介绍了另一种预训练层前馈神经网络 Many-layered Feedforward Neural Networks(FNNs) 的方法,一次训练一层,将每一层都视为无监督的受限玻尔兹曼机,然后使用监督式反向传播进行微调。与浅层人工神经网络类似,深层神经网络可以模拟复杂的非线性关系。在过去的几年里,机器学习算法和计算机硬件的进步催生了更有效的方法,训练包含许多层非线性隐藏单元和一个非常大的输出层的深层神经网络。[108]

深度学习通常使用卷积神经网络 ConvolutionalNeural Networks CNNs ,其起源可以追溯到1980年由福岛邦彦引进的新认知机。[109] 1989年扬·勒丘恩(Yann LeCun)和他的同事将反向传播算法应用于这样的架构。在21世纪初,在一项工业应用中,CNNs已经处理了美国大约10% 到20%的签发支票。[110]

自2011年以来,在 GPUs上快速实现的 CNN 赢得了许多视觉模式识别比赛。[102]

2016年Deepmind 的“AlphaGo Lee”使用了有12个卷积层的 CNNs 和强化学习,击败了一个顶级围棋冠军。[111]

深层循环(递归)神经网络

早期,深度学习也被用于循环神经网络 Recurrent Neural Networks(RNNs) 的序列学习[112],可以运行任意程序来处理任意的输入序列。一个循环神经网络的深度是无限制的,取决于其输入序列的长度; 因此,循环神经网络是一个深度学习的例子[102],[113][114][115]但却存在梯度消失问题。[100][116]1992年的一项研究表明无监督的预训练循环神经网络可以加速后续的深度序列问题的监督式学习。[117]

许多研究人员现在使用着一种被称为 长短期记忆 Long Short-term Memory(LSTM)的网络——一种深度学习循环神经网络的变体,由霍克赖特和施米德胡贝在1997年提出。[118]人们通常使用连接时序分类 Connectionist Temporal Classification, CTC训练LSTM[119]。谷歌,微软和百度用CTC彻底改变了语音识别。例如,2015年谷歌的语音识别性能大幅提升了49%,现在数十亿智能手机用户都可以通过谷歌声音使用这项技术。谷歌也使用LSTM来改进机器翻译,例如2015年,通过训练的LSTM,谷歌的语音识别性能大幅提升了49%,现在通过谷歌语音可以被数十亿的智能手机用户使用。谷歌还使用LSTM来改进机器翻译、语言建模和多语言语言处理。LSTM与CNNs一起使用改进了自动图像字幕的功能等众多应用。[120][121][122]

评估进度

AI和电或蒸汽机一样,是一种通用技术。AI 擅长什么样的任务,这个问题尚未达成共识[123]。虽然像 AlphaZero 这样的项目已经能做到从零开始产生知识,但是许多其他的机器学习项目仍需要大量的训练数据集[124][125]。研究人员吴恩达认为,作为一个“极不完美的经验法则”,“几乎任何普通人只需要不到一秒钟的思考就能做到的事情,我们现在或者在不久的将来都可以使用AI做到。”莫拉维克悖论表明,AI在执行许多人类大脑专门进化出来的、能够很好完成的任务时表现不如人类。[126] Moravec's paradox suggests that AI lags humans at many tasks that the human brain has specifically evolved to perform well.[62]

游戏是评估进步率用的一个广泛认可的基准。2016年前后,AlphaGo 为传统棋类基准的时代的拉下终幕。[127][128] 不过,不完全知识的游戏给AI在博弈论领域提出了新的挑战。星际争霸等电子竞技现在仍然是一项的公众基准。[129][130] 现在出现了设立了有许多如 Imagenet 挑战赛的比赛和奖项以促进AI研究。最常见的比赛内容包括通用机器智能、对话行为、数据挖掘、机器人汽车、机器人足球以及传统游戏。 [131]

“模仿游戏”(对1950年图灵测试的一种解释,用来评估计算机是否可以模仿人类)如今被认为过于灵活,所以不能成为有一项意义的基准[132]。图灵测试衍生出了全自动区分计算机和人类的图灵测试 Completely Automated Public Turing test to tell Computers and Humans Apart(CAPTCHA),顾名思义,这有助于确定用户是一个真实的人,而不是一台伪装成人的计算机。与标准的图灵测试不同,CAPTCHA 是由机器控制,面向人测试,而不是由人控制的,面向机器测试的。计算机要求用户完成一个简单的测试,然后给测试评出一个等级。计算机无法解决这个问题,所以一般认为只有人参加测试才能得出正确答案。验证码的一个常见类型是要求输入一幅计算机无法破译的图中扭曲的字母,数字或符号测试。

“通用智能”测试旨在比较机器、人类甚至非人类动物在尽可能通用的问题集上的表现。在极端情况下,测试集可以包含所有可能出现的问题,再通过柯尔莫哥洛夫复杂度赋予权重;可是这些问题集里大多数问题都是不怎么难的模式匹配练习,在这些练习中,优化过的AI可以轻易地超过人类。[133]

应用

AI与任何智力任务都息息相关。现代AI技术无处不在[134] ,数量众多,无法在此列举。通常,当一种技术变成主流应用时,它就不再被认为是AI; 这种现象被称为AI效应。

大众常见的AI包括自动驾驶(如无人机和自动驾驶汽车)、医疗诊断、艺术创作(如诗歌)、证明数学定理、玩游戏(如国际象棋或围棋)、搜索引擎(如谷歌搜索)、在线助手(如 Siri)、图像识别、垃圾邮件过滤、航班延误预测[135] 、司法判决预测[136] 、投放在线广告[137][138]和能源储存[139]。

随着社交媒体网站取代电视成为年轻人获取新闻的来源,以及新闻机构越来越依赖社交媒体平台来发布新闻[140],大型出版商现在使用AI技术发布新闻,这样做效率更高且能带来更多的流量[141]。

AI还可以用来生成“深度虚假(DeepFake)”,这是一种内容改变技术。至顶网报道说,“它展示出一些并没有真正发生的事情。”尽管88% 的美国人认为换脸弊大于利,但只有47%的人认为自己会成为换脸对象。选举年的盛况也让公众开始讨论起虚假政治视频的害处[142]。

医疗

在医疗保健中,AI通常被用于分类,它既可以自动对 CT 扫描或心电图EKG进行初步评估,又可以在人口健康调查中识别高风险患者。AI的应用范围正在迅速扩大。

例如研究结果表明,AI在成本高昂的剂量问题上可以节省160亿美元。2016年,加利福尼亚州的一项开创性研究报道,在AI的辅助下得到的一个数学公式,给出了器官患者免疫抑制药的准确剂量[143] 。

AI还能协助医生。据彭博科技报道,微软已经开发出帮助医生找到正确的癌症治疗方法的AI[144]。如今有大量的研究和药物开发与癌症有关,准确来说有800多种可以治疗癌症的药物和疫苗。这对医生来说并不是一件好事,因为选项太多,使得为病人选择合适的药物变得更难。微软正在开发一种名为“汉诺威”的机器。它的目标是记住所有与癌症有关的论文,并帮助预测哪些药物的组合对病人最有效。目前正在进行的一个项目是抗击髓系白血病,这是一种致命的癌症,几十年来治疗水平一直没有提高。据报道,另一项研究发现,AI在识别皮肤癌方面与训练有素的医生一样优秀[145]。另一项研究是使用AI通过询问每个高风险患者多个问题来监测他们,这些问题是基于从医生与患者的互动中获得的数据产生的[146]。其中一项研究是通过转移学习完成的,机器进行的诊断类似于训练有素的眼科医生,可以在30秒内做出是否应该转诊治疗的决定,准确率超过95% [147]。

据 CNN 报道,华盛顿国家儿童医疗中心的外科医生最近的一项研究成功演示了一台自主机器人手术。研究组观看了机器人做软组织手术、在开放手术中缝合猪肠的整个过程,并认为比人类外科医生做得更好[148] 。IBM已经创造了自己的AI计算机——IBM 沃森,它在某种程度上已经超越了人类智能。沃森一直在努力实现医疗保健领域的应用[149]。

汽车

在AI领域,自动驾驶汽车的创造和发展促进了汽车行业的增长。目前有超过30家公司利用AI开发自动驾驶汽车,包括特斯拉、谷歌和苹果等[150]。

自动驾驶汽车的功能的实现需要很多组件。这些车辆集成了诸如刹车、换车道、防撞、导航和测绘等系统。这些系统和高性能计算机一起被装配到一辆复杂的车中.[151]。

自动驾驶汽车的最新发展使自动驾驶卡车的创新成为可能,尽管它们仍处于测试阶段。英国政府已通过立法,于2018年开始测试自动驾驶卡车列队行驶[152]。自动驾驶卡车队列是指一排自动驾驶卡车跟随一辆非自动驾驶卡车,所以卡车排还不是完全自动的。与此同时,德国汽车公司戴姆勒正在测试Freightliner Inspiration,这是一种只在高速公路上行驶的半自动卡车[153]。

影响无人驾驶汽车性能的一个主要因素是地图。一般来说,一张行驶区域的地图会被预先写入车辆中。这张地图将包括街灯和路缘高度的近似数据,让车辆能够感知周围环境。然而谷歌一直在研究一种不需要预编程地图的算法,创造一种能够适应各种新环境的设备[154]。一些自动驾驶汽车没有配备方向盘或刹车踏板,因此也有研究致力于创建感知速度和驾驶条件的算法,为车内乘客提供一个安全的环境[155]。

衡量无人驾驶汽车能力的另一个因素是乘客的安全。工程师们必须对无人驾驶汽车进行编程,使其能够处理比如与行人正面相撞等高风险情况。这辆车的主要目标应该是做出一个避免撞到行人,保护车内的乘客的决定。但是有时汽车也可能也会不得不决定将某人置于危险之中。也就是说,汽车需要决定是拯救行人还是乘客[156]。汽车在这些情况下的编程对于一辆成功的无人驾驶汽车是至关重要的。

金融和经济

长期以来,金融机构一直使用人工神经网络系统来检测超出常规的费用或申诉,并将其标记起来等待人工调查。AI在银行业的应用可以追溯到1987年,当时美国国家安全太平洋银行成立了一个防防诈特别小组,以打击未经授权使用借记卡的行为[157]。Kasisto 和 Moneystream等程序正在把AI技术使用到金融服务领域。

如今,银行使用AI系统来组织业务、记账、投资股票和管理房地产。AI可以对突然的变化和没有业务的情况做出反应[158]。2001年8月,机器人在一场模拟金融交易竞赛中击败了人类[159]。AI还通过监测用户的行为模式发现异常变化或异常现象,减少了欺诈和金融犯罪[160][161][162]。

人AI正越来越多地被企业所使用。马云发表过一个有争议的预测:距离AI当上CEO还有30年的时间[163][164]。

AI机器在市场上如在线交易和决策的应用改变了主流经济理论[165]。例如,基于AI的买卖平台改变了供求规律,因为现在可以通过AI很容易地估计个性化需求和供给曲线,从而实现个性化的定价。此外,AI减少了交易的信息不对称,在使市场更有效率的同时也减少了交易量。此外,AI限定了市场行为的后果,进一步提高了交易效率。受AI影响的其他理论包括理性选择、理性预期、博弈论、刘易斯转折点、投资组合优化和反事实思维。2019年8月,AICPA 为会计专业人员开设了 AI 培训课程[166]。

网络安全

网络安全领域面临着各种大规模黑客攻击的重大挑战,这些攻击损害到了很多组织,造成了数十亿美元的商业损失。网络安全公司已经开始使用AI和自然语言处理(NLP) ,例如,SIEM (Security Information and Event Management,安全信息和事件管理)解决方案。更高级的解决方案使用AI和自然语言处理将网络中的数据划分为高风险和低风险两类信息。这使得安全团队能够专注于对付那些有可能对组织造成真正伤害的攻击,不沦为分布式拒绝服务攻击(DoS)、恶意软件和其他攻击的受害者。

政务

政务AI包括应用和管理。AI与人脸识别系统相结合可用于大规模监控。中国的一些地区已经开始使用这种技术[167][168]。一个AI还参与了2018年Tama City市长选举的角逐。

2019年,印度硅谷班加罗尔将在该市的387个交通信号灯上部署AI控制的交通信号系统。这个系统将使用摄像头来确定交通密度,并据此计算清除交通量所需的时间,决定街道上的车辆交通灯的持续时间[169]。

与法律有关的专业

AI正在成为法律相关专业的主要组成部分。一些情况下,人们会通过AI分析处理技术,使用算法和机器学习来完成以前由初级律师完成的工作。

电子资料档案查询产业一直很关注机器学习(预测编码 / 技术辅助评审) ,这是AI的一个子领域。自然语言处理(NLP)和自动语音识别(ASR)也正在这个行业流行起来。

电子游戏

在视频游戏中,AI通常被用来让非玩家角色 non-player characters(NPCs)中做出动态的目的性行为。此外,还常用简单的AI技术寻路。一些研究人员认为,对于大多数生产任务来说,游戏中的 NPC AI 是一个“已解决问题”。含更多非典型 AI 的游戏有《求生之路 Left 4 Dead》中的 AI 导演和《最高指挥官2 Supreme Commander 2》中的对一个野战排进行的神经演化训练[170][171]。

军事

美国和其他国家正在为一系列军事目的开发AI应用程序[172]。AI和机器学习的主要军事应用是增强 C2、通信、传感器、集成和互操作性。情报收集和分析、后勤、网络操作、信息操作、指挥和控制以及各种半自动和自动车辆等领域正在进行AI研究[173] 人工智能研究正在情报收集和分析、后勤、网络作战、信息作战、指挥和控制以及各种半自动和自动车辆领域进行。AI技术能够协调传感器和效应器、探测威胁和识别、标记敌人阵地、目标获取、协调和消除有人和无人小组(MUM-T)、联网作战车辆和坦克内部的分布式联合火力 。伊拉克和叙利亚的军事行动就采用了AI。

全球每年在机器人方面的军费开支从2010年的51亿美元增加到2015年的75亿美元[174][175]。人们都认为具有自主行动能力的军用无人机很有价值[176]。而许多AI研究人员则正在试图远离AI的军事应用。[177]

待客

在待客行业,基于AI的解决方案通过减少重复性任务的频率、分析趋势、与客户活动和预测客户需求来减少员工负担和提高效率[178][179]。使用AI的酒店服务以聊天机器人、应用程序、虚拟语音助手和服务机器人的形式呈现[180]。

审计

在财务报表审计这方面,AI 使得持续审计成为可能。AI工具可以迅速分析多组不同的信息。AI应用带来的可能的好处包括减少总体审计风险,提高审计水平,缩短审计时间。[181]

广告

AI通过客户的数字足迹预测或归纳客户的行为,投放定制广告或者自动构建顾客画像[182]。有记录报告称,线上赌博公司正在使用AI来改进客户定位功能。[183]

此外,个性计算AI模型通过结合心理定位和传统的社会人口学或行为定位方法,帮助降低了广告投放的成本。[184]

艺术

AI催生了许多在如视觉艺术等领域的创造性应用。在纽约现代艺术博物馆举办的“思考机器: 计算机时代的艺术与设计,1959-1989”展览概述了艺术、建筑和设计的历史中AI的应用[185]。最近的展览展示了AI在艺术创作中的应用[186],包括谷歌赞助的旧金山灰色地带基金会 Gray Area Foundation的慈善拍卖会,艺术家们在拍卖会中尝试了 DeepDream 算法,以及2017年秋天在洛杉矶和法兰克福举办的“非人类: AI时代的艺术”展览.[187][188]。2018年春天,计算机协会发行了一期主题为计算机和艺术的特刊,着重展示了机器学习在艺术中的作用。奥地利电子艺术博物馆和维也纳应用艺术博物馆于2019年开设了AI展览[189][190]。2019年的电子艺术节 “Out of the box”将AI艺术在可持续社会转型中的作用变成了一个主题[191]。

哲学和伦理学

有三个与人工智能相关的哲学问题:

- 通用人工智能可能实现吗?机器能解决任何人类使用智能就能解决的问题吗?或者一台机器所能完成的事情是否有严格的界限?

- 智能机器危险吗?我们怎样才能确保机器的行为和使用机器的过程符合道德规范?

- 机器能否拥有与人类完全相同的思维、意识和精神状态?一台机器是否能拥有直觉,因此得到某些权利?机器会做出刻意伤害吗?

人工智能的局限性

机器是智能的吗?它能“思考”吗?

Alan Turing的“礼貌惯例: 我们不需要决定一台机器是否可以“思考”;我们只需要决定一台机器是否可以像人一样聪明地行动。这个对AI相关哲学问题的回应成为了图灵测试的基础。

达特茅斯提案:达特茅斯会议提出: “可以通过准确地描述学习的每个方面或智能的任何特征,使得一台机器模拟学习和智能。”这个猜想被写在了1956年达特茅斯学院会议的提案中。

Newell和Simon的物理符号系统假说: 物理符号系统是通往通用智能行为的充分必要途径。Newell和Simon认为智能由符号形式的运算组成。Hubert Dreyfus则相反地认为,人类的知识依赖于无意识的本能,而不是有意识的符号运算;依赖于对情境的“感觉”,而不是明确的符号知识。

哥德尔的论点:哥德尔本人 、John Lucas(在1961年——和Roger Penrose(在1989年以后的一个更详细的争论中)提出了高度技术性的观点,认为人类数学家可以看到他们自己的“哥德尔不完备定理 Gödel Satements”的真实性,因此计算能力超过机械图灵机。然而,也有一些人不同意“哥德尔不完备定理”。[192][193][194]

人工大脑的观点: 因为大脑可以被机器模拟,且大脑是智能的,模拟的大脑也必须是智能的;因此机器可以是智能的。Hans Moravec、Ray Kurzweil和其他人认为,技术层面直接将大脑复制到硬件和软件上是可行的,而且这些拷贝在本质上和原来的大脑是没有区别的。

AI效应: 机器本来就是智能的,但是观察者却没有意识到这一点。当深蓝在国际象棋比赛中击败加里 · 卡斯帕罗夫时,机器就在做出智能行为。然而,旁观者通常对AI程序的行为不屑一顾,认为它根本不是“真正的”智能; 因此,“真正的”智能就是人任何类能够做到但机器仍然做不到的智能行为。这就是众所周知的AI效应: “AI就是一切尚未完成的事情"。

潜在危害

AI的广泛使用可能会产生危险或导致意外后果。生命未来研究所等机构的科学家提出了一些短期研究目标,以此了解AI如何影响经济、与AI相关的法律和道德规范,以及如何将AI的安全风险降到最低。从长远来看,科学家们建议继续优化功能,同时最小化新技术带来的可能的安全风险。[195]

AI和自动化潜在的负面影响在安德鲁·杨2020年竞选美国总统的过程中体现了出来[196] 。联合国人工智能与机器人中心主任伊拉克利·贝瑞德兹表示: ”我认为AI危害会体现在犯罪分子或大型恐怖组织利用AI破坏大型流程或通过数字战争造成损失,也可能是机器人、无人机、AI以及其他可能非常危险的东西的结合。当然,其还有失业等风险。如果大量的人失去工作,而且没有解决方案,这将是极其危险的。另外,致命的自动化武器系统之类的东西应该得到合适的控制,否则就可能会被大量滥用。”[197]

存在风险

物理学家斯蒂芬·霍金、微软创始人比尔·盖茨和 SpaceX 公司创始人埃隆·马斯克对AI进化到人类无法控制的程度表示担忧,霍金认为这可能“会导致人类末日”。[198][199][200]

在《超级智能 Superintelligence: Paths, Dangers, Strategies》一书中,哲学家Nick Bostrom提出了一个AI将对人类构成威胁的论点。他认为,如果足够智能的AI选择有目标地行动,它将表现出收敛的行为,如获取资源或保护自己不被关机。如果这个AI的目标没有人性,比如一个AI被告知要尽可能多地计算圆周率的位数,那么它可能会伤害人类,以便获得更多的资源或者防止自身被关闭,最终更好地实现目标。Bostrom还强调了向高级AI充分传达人类价值观存在的困难。他假设了一个例子来说明一种南辕北辙的尝试: 给AI一个让人类微笑的目标。Bostrom认为,如果这种情况下的AI变得非常聪明,它可能会采用大多数人类都会感到恐怖的方法,比如“在人类面部肌肉中插入电极,使其产生持续的笑容” ,因为这将是实现让人类微笑的目标的有效方法。[201]AI研究人员Stuart J. Russell在他的《人类相容 Human Compatible》一书中回应了博斯特罗姆的一些担忧,同时也提出了一种开发可证明有益的机器可能涉及逆强化学习的方法[202],这种机器侧重解决不确定性和顺从人类的问题。[202]

对人工智能潜在风险的担忧引来了一些大额的捐献和投资。一些科技巨头,如 Peter Thiel、亚马逊云服务、以及Musk已经把10亿美金给了OpenAI,一个拥护和聚焦于开发可靠的AI的非盈利公司。[203] 人工智能领域内专家们的观点是混杂的,担忧和不担忧超人类AI的意见都占有很大的份额。其他技术行业的领导者相信AI在目前的形式下是有益的,并将继续帮助人类。甲骨文首席执行官Mark Hurd 表示,AI“实际上将创造更多的就业机会,而不是减少就业机会” ,因为管理AI系统需要人力[204] 。Facebook 首席执行官Mark Zuckerberg相信AI将“解锁大量正面的东西” ,比如治愈疾病和提高自动驾驶汽车的安全性[205]。2015年1月,马斯克向未来生命研究所捐赠了1000万美元,用于研究AI决策。该研究所的目标是“用智能管理”日益增长的技术力量。Vicarious还为 DeepMind 和 Vicarious 等开发AI的公司提供资金,以“跟进AI的发展”[206]因为认为这个领域“可能会产生危险的后果”[207][208]。

如果要实现不受控制的高级AI,这个假想中的AI必须超越或者说在思想上超越全人类,一小部分专家认为这种可能性在足够遥远未来才会出现,不值得研究。[209][210] 其他反对意见则认为,从AI的角度来看,人类或者具有内在价值,或者具有可交流的价值。[211]

人性贬值

Joseph Weizenbaum写道,根据定义,AI应用程序不能模拟人类的同理心,并且在诸如客户服务或心理治疗等领域使用AI技术是严重错误。维森鲍姆还对AI研究人员(以及一些哲学家)将人类思维视为一个计算机程序(现在称为计算主义)而感到困扰。对维森鲍姆来说,这些观点表明AI研究贬低了人类的生命价值。

社会正义

人们担心的一个问题是,AI程序可能会对某些群体存在偏见,比如女性和少数族裔,因为大多数开发者都是富有的白人男性[212]。男性对AI的支持率(47%)高于女性(35%)。

算法在今天的法律体系中已经有了大量的应用,它能协助法官以及假释官员,以及哪些负责评估被告再次犯罪可能性的公设辩护人[213]。替代性制裁的惩罚性罪犯管理分析 Correctional Offender Management Profiling for Alternative Sanctions(COMPAS)是商业上使用最广泛的解决方案之一[213]。有人指出,COMPAS 对黑人被告累犯风险的评估数值非常高,而相反的,白人被告低风险估计的频率明显高于统计学期望。[213]

劳动力需求降低

自动化与就业的关系是复杂的。自动化在减少过时工作的同时,也通过微观经济和宏观经济效应创造了新的就业机会[214]。与以往的自动化浪潮不同,许多中产阶级的工作可能会被AI淘汰。《经济学人》杂志指出,“AI对白领工作的影响,就像工业革命时期蒸汽动力对蓝领工作的影响一样,需要我们正视”[215]。对风险的主观估计差别很大,例如,Michael Osborne和Carl Benedikt Frey估计,美国47% 的工作有较高风险被自动化取代 ,而经合组织的报告认为美国仅有9% 的工作处于“高风险”状态[216][217][218]。从律师助理到快餐厨师等职业都面临着极大的风险,而个人医疗保健、神职人员等护理相关职业的就业需求可能会增加[219]。作家Martin Ford和其他人进一步指出,许多工作都是常规、重复的,对AI而言是可以预测的。Ford警告道,这些工作可能在未来几十年内实现自动化,而且即便对失业人员进行再培训,许多能力一般的人也不能获得新工作。经济学家指出,在过去技术往往会增加而不是减少总就业人数,但他们承认,AI“正处于未知领域”[24]。

自动化武器

目前,包括美国、中国、俄罗斯和英国在内的50多个国家正在研究战场机器人。许多人在担心来自超级智能AI的风险的同时,也希望限制人造士兵和无人机的使用。[220]

道德机器

具有智能的机器有潜力使用它们的智能来防止伤害和减少风险;它们也有能力利用伦理推理来更好地做出它们在世界上的行动。因此,有必要为AI和机器人制定和规范政策[221]。这一领域的研究包括机器伦理学、人工道德主题、友好AI以及关于建立人权框架的讨论[222]。

人工道德智能主体

Wendell Wallach在他的著作《道德机器 Moral Machines》[223]中提出了人工道德智能主体(AMA)的概念。在两个核心问题的指导下,AMA 已经成为AI研究领域的一部分。他将这两个核心问题定义为“人类是否希望计算机做出道德决策”和“机器人真的可以拥有道德吗”。对于Wallach来说,这个问题的重点并不是机器能否适应社会,表现与社会对AMA发展所施加的限制相对应的道德行为。

机器伦理学

机器伦理学领域关注的是给予机器伦理原则,或者一种用于解决它们可能遇到的伦理困境的方法,使它们能够通过自己的伦理决策以一种符合伦理的方式运作.[224]。2005年秋季AAAI机器伦理研讨会描述了这一领域: ”过去关于技术与伦理学之间关系的研究主要侧重于人类是否应该对技术的使用负责,只有少数人对人类应当如何对待机器感兴趣。任何时候都只有人类会参与伦理推理。现在是时候给至少一些机器增加道德层面的考虑了。这势必要的,因为我们认识到了机器行为的道德后果,以及机器自主性领域最新和潜在的发展。与计算机黑客行为、软件产权问题、隐私问题和其他通常归因于计算机道德的主题不同,机器道德关注的是机器对人类用户和其他机器的行为。机器伦理学的研究是减轻人们对自主系统担忧的关键——可以说,人们对机器智能担忧的根源是自主机器概念没有道德维度。此外,在机器伦理学的研究中可以发现当前伦理学理论存在的问题,加深我们对伦理学的思考。”[225] 机器伦理学有时被称为机器道德、计算伦理学或计算伦理学[224]。这个新兴领域的各种观点可以在 AAAI 秋季2005年机器伦理学研讨会上收集的“机器伦理学”版本中找到。[225]

善AI与恶AI

政治科学家Charles T. Rubin认为,AI既不可能被设计成是友好的,也不能保证会是友好的[226]。他认为“任何足够的友善都可能难以与邪恶区分。”人类不应该假设机器或机器人会对我们友好,因为没有先验理由认为他们会对我们的道德体系有共鸣。这个体系是在我们特定的生物进化过程中产生的(AI没有这个过程)。超智能软件不一定会认同人类的继续存在,且我们将极难停止超级AI的运转。最近一些学术出版物也开始讨论这个话题,认为它是对文明、人类和地球造成风险的真正来源。

解决这个问题的一个建议是确保第一个具有通用智能的AI是“友好的AI”,并能够控制后面研发的AI。一些人质疑这种“友好”是否真的能够保持不变。

首席AI研究员Rodney Brooks写道: “我认为担心我们在未来几百年的研发出邪恶AI是无稽之谈。我觉得这种担忧源于一个根本性的错误,即没有认识到AI在某些领域进展可以很快,但构建有意识有感情的智能则是件庞杂且艰巨的任务。”[227]

机器意识、知觉和思维

如果一个AI系统复制了人类智能的所有关键部分,那么这个系统是否也能有意识——它是否能拥有一个有知觉的头脑?这个问题与人类意识本质的哲学问题密切相关,一般称之为意识难题。

意识

David Chalmers在理解心智方面提出了两个问题,他称之为意识的“困难”和“容易”问题。 [228]

“容易”的问题是理解大脑如何处理信号,制定计划和控制行为。“困难”的问题是如何解释这种感觉或者为什么它会有这种感觉。人类的信息处理过程很容易解释,然而人类的主观体验却很难解释。

例如当一个人看到一张色卡并识别它,说“它是红色的”时会发生什么。这个简单的问题只需要知道这个人大脑中认出色卡是红色的机制。困难的问题是,人们还知道其他一些东西——他们还知道红色长什么样。(一个天生失明的人也能知道什么是红色,即使不知道红色是什么样子。)每个人都知道主观体验的存在,因为他们每天都有主观体验(例如,所有视力正常的人都知道红色是什么样子)。困难的问题是解释大脑如何创造它,为什么它存在,以及它如何区别于知识和大脑的其他方面。

计算主义和功能主义

计算主义站在心智哲学的立场,认为人类心智或人类大脑是一个信息处理系统,思维是一种计算形式[229] 。计算主义认为,思想和身体之间的关系与软件和硬件之间的关系是相似或相同的,因此这也许能帮助解决“意识和身体问题”。这一哲学立场受20世纪60年代AI研究人员和认知科学家的工作的启发,最初由哲学家Jerry Fodor和Hilary Putnam提出。

强人工智能假说

“具有正确输入和输出程序的计算机,将因此拥有与人脑意义完全相同的头脑。”John Searle称这种哲学立场为“强人工智能”,然后用他的中文屋论点反驳了这种说法,他让人们看看电脑内部,并试图找出“思维”可能在哪里。

机器人的权利

如果可以创造出一台有智能的机器,那么它是否也有感觉呢?如果它有感觉,它是否拥有与人类同样的权利?这个目前被称为“机器人权利”的问题正在被人们考虑,例如,加利福尼亚的未来研究所就在从事相关研究,尽管许多批评论家认为这种讨论为时过早[230]。2010年的纪录片《插头与祷告 Plug & Pray》[231]以及《星际迷航: 下一代 Star Trek Next Generation》等许多科幻媒体都对这个主题进行了深入讨论。《星际迷航 Star Trek》中有个指挥官角色叫Data ,他希望“变成人类”,和为了不被拆解而抗争。

超级智能

智能机器——或者说人机混合体——能达到的怎样的程度有限吗?超级智能、超智能或者超人智能是一种假想的智能主体,它拥有的智能远远超过最聪明、最有天赋的人类智慧。超级智能也可以指这种智能体所拥有的智能的形式或程度。[69]

技术奇点

如果对强人工智能的研究造出了足够智能的软件,那么它也许能做到重新编程并改进自己。改进后的软件甚至可以更好地改进自己,从而实现递归的自我改进。这种新的智能因此可以呈指数增长,并大大超过人类。科幻作家弗诺·文奇将这种情况命名为“奇点”:技术的加速发展将导致AI超越人类智力和控制能力的失控局面,从而彻底改变甚至终结人类文明。因为这样的智能人类难以理解,所有技术奇点出现后发生的事是不可预测,或者说深不可测的。

Ray Kurzweil利用摩尔定律(描述了数字技术指数增长的现象)计算出,到2029年,台式电脑的处理能力将与人类大脑相当,并预测奇点将出现在2045年。

超人类主义

机器人设计师Hans Moravec、控制论专家Kevin Warwick和发明家Ray Kurzweil预言,人类和机器将在未来融合成为比两者都更强的半机器人。这种观点被称为“超人类主义”,这种观点起源于Aldous Huxley和Robert Ettinger。

Edward Fredkin认为,“人工智能是进化的下一个阶段”。早在1863年Samuel Butler的《机器中的达尔文 Darwin among the Machines》就首次提出了这一观点,George Dyson在1998年的同名著作中对其进行了延伸。

经济学 Economics

人工智能的长期经济效应是不确定的。一项对经济学家的调查显示,在机器人和AI的使用的日益增加是否会导致长期失业率大幅上升的问题上,人们的意见存在分歧。但他们普遍认为,如果生产力提高的成果得到重新分配,也许这也不是一件坏事[232]。2020年2月,欧盟发表了一份关于AI的白皮书,主张为了增加经济利益而使用AI,其中包括“改善医疗保健(例如:使诊断更加精确,能够更好地预防疾病) ,提高耕作效率,为缓解和适应气候变化做出贡献,以及通过预测性维护提高生产系统的效率”,同时也承认AI有潜在风险[134]。

规范 Regulation

促进和规范AI的公共部门政策被认为对鼓励人工智能和控制相关风险是必要的,但具有挑战性[233] 。2017年,Elon Musk呼吁监管AI的发展[234]。多个国家现在正在制定或实施国家性政策[235] ,2020年2月,欧盟公布了促进和管理AI的战略文件草案[236]。

小说 In fiction

自古以来,具有思考能力的人工生物就作为叙事工具在小说中出现,并一直是科幻小说中的一个永恒主题。 在这些作品中,Mary Shelley的《弗兰肯斯坦 Frankenstein》最先使用了这种常见的提法 ,在这部作品中,人造物对其主人产生了威胁。这些作品包括Arthur C. Clarke和Stanley Kubrick的《2001: 太空漫游 2001: A Space Odyssey》,包括哈尔9000(HAL 9000) ,负责发现一号飞船的凶残计算机,以及《终结者 The Terminator》和《黑客帝国 The Matrix》。相比之下,像《地球停止转动的日子》(1951)中的格特和《异形》(1986)中的毕晓普(Bishop)这样罕见的忠诚机器人在流行文化中就不那么突出了。[237]

Isaac Asimov在许多书籍和故事中介绍了机器人三定律,最著名的是关于同名的“Multitvac”超级智能计算机系列。阿西莫夫定律经常在茶余饭后对机器伦理的讨论中被提起。几乎所有的AI研究人员都通过流行文化熟悉阿西莫夫定律,但他们通常认为这些定律因为许多原因而无用,其中一个原因就是它们的描述过于模糊。[238]

漫画《攻壳机动队 manga Ghost in the Shell》和科幻小说《沙丘 Dune》探讨了超人类主义(人类和机器的结合)。20世纪80年代,艺术家空山基的性感机器人系列在日本绘制并出版,描绘了真实的拥有栩栩如生的金属肌肉皮肤的有机人类形体,后来又出版了《雌蕊》一书,该书被George Lucas等电影制作人使用。空山基从来不认为这些有机机器人是自然的一部分,而是非自然的人类心智的产品,一个存在于头脑中,也许能以实体形式实现的幻想。

一些作品向我们展示了有感知的能力,因此也有遭受苦难的能力的AI,迫使我们面对是什么让我们成为人类这一根本问题。这些都在Karel Čapek的电影《人工智能 A.I. Artificial Intelligence》、《机器姬 Ex Machina》,以及Philip K. Dick的小说《机器人会梦见电子羊吗? Do Androids Dream of Electric Sheep?》中都有出现。Dick认为,AI创造的技术改变了我们对人类主观性的理解。[239]

参见

- 溯因推理 Abductive reasoning

- 基于案例的推理 Case-based reasoning

- 常识推理 Commonsense reasoning

- 涌现算法 Emergent algorithm

- 进化计算 Evolutionary computation

- 机器学习 Machine learning

- 数学优化 Mathematical optimization

- 多主体系统 Multi-agent system

引用

- ↑ Poole, David; Mackworth, Alan; Goebel, Randy (1998). Computational Intelligence: A Logical Approach. New York: Oxford University Press. ISBN 978-0-19-510270-3.

- ↑ Russell, Stuart J.; Norvig, Peter (2003), Artificial Intelligence: A Modern Approach (2nd ed.), Upper Saddle River, New Jersey: Prentice Hall, ISBN 0-13-790395-2

- ↑ Nilsson, Nils (1998). Artificial Intelligence: A New Synthesis. Morgan Kaufmann. ISBN 978-1-55860-467-4.

- ↑ Legg, Shane; Hutter, Marcus (15 June 2007). A Collection of Definitions of Intelligence (Technical report). IDSIA. arXiv:0706.3639. Bibcode:2007arXiv0706.3639L. 07-07.

- ↑ "AlphaGo – Google DeepMind". Archived from the original on 10 March 2016.

- ↑ McCorduck, Pamela (2004), Machines Who Think (2nd ed.), Natick, MA: A. K. Peters, Ltd., ISBN 1-56881-205-1, p. 204

- ↑ Ashok83 (10 September 2019). "How AI Is Getting Groundbreaking Changes In Talent Management And HR Tech". Hackernoon. Archived from the original on 11 September 2019. Retrieved 14 February 2020.

- ↑ Schank, Roger C. (1991). "Where's the AI". AI magazine. Vol. 12 no. 4, p. 38

- ↑ Simon, H. A. (1965). The Shape of Automation for Men and Management. New York: Harper & Row.

- ↑ 10.0 10.1 10.2 10.3 10.4 10.5 Crevier, Daniel (1993), AI: The Tumultuous Search for Artificial Intelligence, New York, NY: BasicBooks, ISBN 0-465-02997-3

- ↑ 11.0 11.1 11.2 11.3 11.4 11.5 11.6 11.7 McCorduck, Pamela (2004), Machines Who Think (2nd ed.), Natick, MA: A. K. Peters, Ltd., ISBN 1-56881-205-1

- ↑ 12.00 12.01 12.02 12.03 12.04 12.05 12.06 12.07 12.08 12.09 12.10 12.11 12.12 12.13 12.14 12.15 12.16 12.17 12.18 12.19 12.20 12.21 12.22 12.23 12.24 12.25 12.26 12.27 12.28 12.29 Russell, Stuart J.; Norvig, Peter (2003), Artificial Intelligence: A Modern Approach (2nd ed.), Upper Saddle River, New Jersey: Prentice Hall, ISBN 0-13-790395-2, pp. 375–459

- ↑ 13.0 13.1 13.2 13.3 NRC (United States National Research Council) (1999). "Developments in Artificial Intelligence". Funding a Revolution: Government Support for Computing Research. National Academy Press.

- ↑ 14.0 14.1 14.2 14.3 14.4 Newquist, HP (1994). The Brain Makers: Genius, Ego, And Greed In The Quest For Machines That Think. New York: Macmillan/SAMS. ISBN 978-0-672-30412-5.

- ↑ Howe, J. (November 1994). "Artificial Intelligence at Edinburgh University: a Perspective".

- ↑ Clark, Jack. "Why 2015 Was a Breakthrough Year in Artificial Intelligence". Bloomberg.com.

- ↑ 17.0 17.1 17.2 Kurzweil, Ray (2005). The Singularity is Near. Penguin Books. ISBN 978-0-670-03384-3.

- ↑ 18.00 18.01 18.02 18.03 18.04 18.05 18.06 18.07 18.08 18.09 18.10 18.11 18.12 18.13 18.14 Luger, George; Stubblefield, William (2004). Artificial Intelligence: Structures and Strategies for Complex Problem Solving (5th ed.). Benjamin/Cummings. ISBN 978-0-8053-4780-7.

- ↑ 19.00 19.01 19.02 19.03 19.04 19.05 19.06 19.07 19.08 19.09 19.10 19.11 19.12 19.13 19.14 Poole, David; Mackworth, Alan; Goebel, Randy (1998). Computational Intelligence: A Logical Approach. New York: Oxford University Press. ISBN 978-0-19-510270-3. Archived from the original on 26 July 2020. Retrieved 22 August 2020.

- ↑ 20.00 20.01 20.02 20.03 20.04 20.05 20.06 20.07 20.08 20.09 20.10 20.11 20.12 20.13 20.14 20.15 Nilsson, Nils (1998). Artificial Intelligence: A New Synthesis. Morgan Kaufmann. ISBN 978-1-55860-467-4. Archived from the original on 26 July 2020. Retrieved 18 November 2019.

- ↑ 21.0 21.1 Kurzweil, Ray (1999). The Age of Spiritual Machines. Penguin Books. ISBN 978-0-670-88217-5.

- ↑ Spadafora, Anthony (21 October 2016). "Stephen Hawking believes AI could be mankind's last accomplishment". BetaNews. Archived from the original on 28 August 2017.

- ↑ Lombardo, P; Boehm, I; Nairz, K (2020). "RadioComics – Santa Claus and the future of radiology". Eur J Radiol. 122 (1): 108771. doi:10.1016/j.ejrad.2019.108771. PMID 31835078.

- ↑ 24.0 24.1 Ford, Martin; Colvin, Geoff (6 September 2015). "Will robots create more jobs than they destroy?". The Guardian. Retrieved 13 January 2018.

- ↑ Formal reasoning: * Berlinski, David (2000). The Advent of the Algorithm. Harcourt Books. ISBN 978-0-15-601391-8. OCLC 46890682.

- ↑ Turing, Alan (1948), "Machine Intelligence", in Copeland, B. Jack (ed.), The Essential Turing: The ideas that gave birth to the computer age, Oxford: Oxford University Press, p. 412, ISBN 978-0-19-825080-7

- ↑ Russell, Stuart J.; Norvig, Peter (2009). Artificial Intelligence: A Modern Approach (3rd ed.). Upper Saddle River, New Jersey: Prentice Hall. ISBN 978-0-13-604259-4.

- ↑ McCarthy, John (1988). "Review of The Question of Artificial Intelligence". Annals of the History of Computing. 10 (3): 224–229., collected in McCarthy, John (1996). "10. Review of The Question of Artificial Intelligence". Defending AI Research: A Collection of Essays and Reviews. CSLI., p. 73

- ↑ 29.0 29.1 29.2 29.3 29.4 29.5 29.6 ACM Computing Classification System: Artificial intelligence". ACM. 1998.

- ↑ "Ask the AI experts: What's driving today's progress in AI?". McKinsey & Company. Archived from the original on 13 April 2018. Retrieved 13 April 2018.

- ↑ Clark, Jack (8 December 2015b). "Why 2015 Was a Breakthrough Year in Artificial Intelligence". Bloomberg.com. Archived from the original on 23 November 2016.

- ↑ "Reshaping Business With Artificial Intelligence". MIT Sloan Management Review. Archived from the original on 19 May 2018. Retrieved 2 May 2018.

- ↑ Lorica, Ben (18 December 2017). "The state of AI adoption". O'Reilly Media. Archived from the original on 2 May 2018. Retrieved 2 May 2018.

- ↑ Wason, P. C.; Shapiro, D. (1966). "Reasoning". In Foss, B. M. (ed.). New horizons in psychology. Harmondsworth: Penguin. Archived from the original on 26 July 2020. Retrieved 18 November 2019.

- ↑ Sikos, Leslie F. (June 2017). Description Logics in Multimedia Reasoning. Cham: Springer. doi:10.1007/978-3-319-54066-5. ISBN 978-3-319-54066-5. Archived from the original on 29 August 2017. https://web.archive.org/web/20170829120912/https://www.springer.com/us/book/9783319540658.

- ↑ Smoliar, Stephen W.; Zhang, HongJiang (1994). "Content based video indexing and retrieval". IEEE Multimedia. 1 (2): 62–72. doi:10.1109/93.311653.

- ↑ Neumann, Bernd; Möller, Ralf (January 2008). "On scene interpretation with description logics". Image and Vision Computing. 26 (1): 82–101. doi:10.1016/j.imavis.2007.08.013.

- ↑ Kuperman, G. J.; Reichley, R. M.; Bailey, T. C. (1 July 2006). "Using Commercial Knowledge Bases for Clinical Decision Support: Opportunities, Hurdles, and Recommendations". Journal of the American Medical Informatics Association. 13 (4): 369–371. doi:10.1197/jamia.M2055. PMC 1513681. PMID 16622160.

- ↑ MCGARRY, KEN (1 December 2005). "A survey of interestingness measures for knowledge discovery". The Knowledge Engineering Review. 20 (1): 39. doi:10.1017/S0269888905000408.

- ↑ Bertini, M; Del Bimbo, A; Torniai, C (2006). "Automatic annotation and semantic retrieval of video sequences using multimedia ontologies". MM '06 Proceedings of the 14th ACM international conference on Multimedia. 14th ACM international conference on Multimedia. Santa Barbara: ACM. pp. 679–682.

- ↑ McCarthy, John; Hayes, P. J. (1969). "Some philosophical problems from the standpoint of artificial intelligence". Machine Intelligence. 4: 463–502. CiteSeerX 10.1.1.85.5082.

- ↑ Russell, Stuart J.; Norvig, Peter (2003), Artificial Intelligence: A Modern Approach (2nd ed.), Upper Saddle River, New Jersey: Prentice Hall, ISBN 0-13-790395-2.

- ↑ Russell, Stuart J.; Norvig, Peter (2003), Artificial Intelligence: A Modern Approach (2nd ed.), Upper Saddle River, New Jersey: Prentice Hall, ISBN 0-13-790395-2

- ↑ Crevier, Daniel (1993), AI: The Tumultuous Search for Artificial Intelligence, New York, NY: BasicBooks, ISBN 0-465-02997-3

- ↑ Moravec, Hans (1988). Mind Children. Harvard University Press. ISBN 978-0-674-57616-2.

- ↑ Nilsson, Nils (1998). Artificial Intelligence: A New Synthesis. Morgan Kaufmann. ISBN 978-1-55860-467-4.

- ↑ Dreyfus, Hubert; Dreyfus, Stuart (1986). Mind over Machine: The Power of Human Intuition and Expertise in the Era of the Computer. Oxford, UK: Blackwell. ISBN 978-0-02-908060-3.

- ↑ Gladwell, Malcolm (2005). Blink. New York: Little, Brown and Co. ISBN 978-0-316-17232-5.

- ↑ Dreyfus, Hubert; Dreyfus, Stuart (1986). Mind over Machine: The Power of Human Intuition and Expertise in the Era of the Computer. Oxford, UK: Blackwell. ISBN 978-0-02-908060-3.

- ↑ Hawkins, Jeff; Blakeslee, Sandra (2005). On Intelligence. New York, NY: Owl Books. ISBN 978-0-8050-7853-4.

- ↑ Russell, Stuart J.; Norvig, Peter (2003), Artificial Intelligence: A Modern Approach (2nd ed.), Upper Saddle River, New Jersey: Prentice Hall, ISBN 0-13-790395-2,pp. 375–430

- ↑ Poole, David; Mackworth, Alan; Goebel, Randy (1998). Computational Intelligence: A Logical Approach. New York: Oxford University Press. ISBN 978-0-19-510270-3, pp. 375–430

- ↑ Russell, Stuart J.; Norvig, Peter (2003), Artificial Intelligence: A Modern Approach (2nd ed.), Upper Saddle River, New Jersey: Prentice Hall, ISBN 0-13-790395-2, pp. 430–449

- ↑ Jordan, M. I.; Mitchell, T. M. (16 July 2015). "Machine learning: Trends, perspectives, and prospects". Science. 349 (6245): 255–260. Bibcode:2015Sci...349..255J. doi:10.1126/science.aaa8415. PMID 26185243.

- ↑ Cambria, Erik; White, Bebo (May 2014). "Jumping NLP Curves: A Review of Natural Language Processing Research [Review Article]". IEEE Computational Intelligence Magazine. 9 (2): 48–57. doi:10.1109/MCI.2014.2307227. S2CID 206451986.

- ↑ Vincent, James (7 November 2019). "OpenAI has published the text-generating AI it said was too dangerous to share". The Verge. Archived from the original on 11 June 2020.

- ↑ 57.0 57.1 Tecuci, Gheorghe (March–April 2012). "Artificial Intelligence". Wiley Interdisciplinary Reviews: Computational Statistics. 4 (2): 168–180. doi:10.1002/wics.200

- ↑ Cadena, Cesar; Carlone, Luca; Carrillo, Henry; Latif, Yasir; Scaramuzza, Davide; Neira, Jose; Reid, Ian; Leonard, John J. (December 2016). "Past, Present, and Future of Simultaneous Localization and Mapping: Toward the Robust-Perception Age". IEEE Transactions on Robotics. 32 (6): 1309–1332. arXiv:1606.05830. Bibcode:2016arXiv160605830C. doi:10.1109/TRO.2016.2624754. S2CID 2596787

- ↑ Cadena, Cesar; Carlone, Luca; Carrillo, Henry; Latif, Yasir; Scaramuzza, Davide; Neira, Jose; Reid, Ian; Leonard, John J. (December 2016). "Past, Present, and Future of Simultaneous Localization and Mapping: Toward the Robust-Perception Age". IEEE Transactions on Robotics. 32 (6): 1309–1332. arXiv:1606.05830. Bibcode:2016arXiv160605830C. doi:10.1109/TRO.2016.2624754.

- ↑ Moravec, Hans (1988). Mind Children. Harvard University Press.

- ↑ Chan, Szu Ping (15 November 2015). "This is what will happen when robots take over the world". Retrieved 23 April 2018.

- ↑ 62.0 62.1 "IKEA furniture and the limits of AI". The Economist (in English). 2018. Retrieved 24 April 2018.

- ↑ Minsky, Marvin (2006). The Emotion Machine. New York, NY: Simon & Schusterl. ISBN 978-0-7432-7663-4.

- ↑ Waddell, Kaveh (2018). "Chatbots Have Entered the Uncanny Valley". The Atlantic.

- ↑ Cao, Yongcan; Yu, Wenwu; Ren, Wei; Chen, Guanrong (February 2013). "An Overview of Recent Progress in the Study of Distributed Multi-Agent Coordination". IEEE Transactions on Industrial Informatics. 9 (1): 427–438. arXiv:1207.3231. doi:10.1109/TII.2012.2219061.

- ↑ Poria, Soujanya; Cambria, Erik; Bajpai, Rajiv; Hussain, Amir (September 2017). "A review of affective computing: From unimodal analysis to multimodal fusion". Information Fusion. 37: 98–125. doi:10.1016/j.inffus.2017.02.003. hdl:1893/25490.

- ↑ Waddell, Kaveh (2018). "Chatbots Have Entered the Uncanny Valley". The Atlantic. Retrieved 24 April 2018.

- ↑ Pennachin, C.; Goertzel, B. (2007). Contemporary Approaches to Artificial General Intelligence. Cognitive Technologies. Berlin, Heidelberg: Springer. doi:10.1007/978-3-540-68677-4_1. ISBN 978-3-540-23733-4.

- ↑ 69.0 69.1 69.2 Roberts, Jacob (2016). "Thinking Machines: The Search for Artificial Intelligence". Distillations. Vol. 2, no. 2. pp. 14–23. Archived from the original on 19 August 2018. Retrieved 20 March 2018.

- ↑ Pennachin, C.; Goertzel, B. (2007). "Contemporary Approaches to Artificial General Intelligence". Artificial General Intelligence. Cognitive Technologies. Berlin, Heidelberg: Springer. doi:10.1007/978-3-540-68677-4_1. ISBN 978-3-540-23733-4.

- ↑ McCorduck, Pamela (2004), Machines Who Think (2nd ed.), Natick, MA: A. K. Peters, Ltd., ISBN 1-56881-205-1

- ↑ 72.0 72.1 72.2 Langley, Pat (2011). "The changing science of machine learning". Machine Learning. 82 (3): 275–279. doi:10.1007/s10994-011-5242-y

- ↑ 73.0 73.1 Katz, Yarden (1 November 2012). "Noam Chomsky on Where Artificial Intelligence Went Wrong". The Atlantic.

- ↑ Haugeland, John (1985). Artificial Intelligence: The Very Idea. Cambridge, Mass.: MIT Press. ISBN 978-0-262-08153-5.

- ↑ Frederick, Hayes-Roth; William, Murray; Leonard, Adelman. "Expert systems". AccessScience (in English). doi:10.1036/1097-8542.248550.

- ↑ Hutson, Matthew (16 February 2018). "Artificial intelligence faces reproducibility crisis". Science (in English). pp. 725–726. Bibcode:2018Sci...359..725H. doi:10.1126/science.359.6377.725. Retrieved 28 April 2018.

- ↑ Norvig, Peter (25 June 2012). "On Chomsky and the Two Cultures of Statistical Learning".

- ↑ Laird, John (2008). "Extending the Soar cognitive architecture". Frontiers in Artificial Intelligence and Applications. 171: 224. CiteSeerX 10.1.1.77.2473.

- ↑ Lieto, Antonio; Lebiere, Christian; Oltramari, Alessandro (May 2018). "The knowledge level in cognitive architectures: Current limitations and possibile developments". Cognitive Systems Research. 48: 39–55. doi:10.1016/j.cogsys.2017.05.001. hdl:2318/1665207.

- ↑ Lieto, Antonio; Bhatt, Mehul; Oltramari, Alessandro; Vernon, David (May 2018). "The role of cognitive architectures in general artificial intelligence". Cognitive Systems Research. 48: 1–3. doi:10.1016/j.cogsys.2017.08.003. hdl:2318/1665249.

- ↑ Holland, John H. (1975). Adaptation in Natural and Artificial Systems. University of Michigan Press. ISBN 978-0-262-58111-0.

- ↑ Koza, John R. (1992). Genetic Programming (On the Programming of Computers by Means of Natural Selection). MIT Press. Bibcode:1992gppc.book.....K. ISBN 978-0-262-11170-6.

- ↑ Poli, R.; Langdon, W. B.; McPhee, N. F. (2008). A Field Guide to Genetic Programming. Lulu.com. ISBN 978-1-4092-0073-4 – via gp-field-guide.org.uk.

- ↑ Daniel Merkle; Martin Middendorf (2013). "Swarm Intelligence". In Burke, Edmund K.; Kendall, Graham (in en). Search Methodologies: Introductory Tutorials in Optimization and Decision Support Techniques. Springer Science & Business Media. ISBN 978-1-4614-6940-7.

- ↑ 85.0 85.1 85.2 "ACM Computing Classification System: Artificial intelligence". ACM. 1998. ~I.2.3 and ~I.2.4.

- ↑ Elkan, Charles (1994). "The paradoxical success of fuzzy logic". IEEE Expert. 9 (4): 3–49. CiteSeerX 10.1.1.100.8402. doi:10.1109/64.336150.

- ↑ "What is 'fuzzy logic'? Are there computers that are inherently fuzzy and do not apply the usual binary logic?". Scientific American (in English). Retrieved 5 May 2018.

- ↑ "The Belief Calculus and Uncertain Reasoning", Yen-Teh Hsia

- ↑ 89.0 89.1 89.2 Domingos, Pedro (2015). The Master Algorithm: How the Quest for the Ultimate Learning Machine Will Remake Our World. Basic Books. ISBN 978-0-465-06192-1.

- ↑ van der Walt, Christiaan; Bernard, Etienne (2006). "Data characteristics that determine classifier performance" (PDF).

- ↑ Russell, Stuart J.; Norvig, Peter (2009). Artificial Intelligence: A Modern Approach (3rd ed.). Upper Saddle River, New Jersey: Prentice Hall. 18.12: Learning from Examples: Summary. ISBN 978-0-13-604259-4.

- ↑ "Why Deep Learning Is Suddenly Changing Your Life". Fortune. 2016. Retrieved 12 March 2018.

- ↑ "Google leads in the race to dominate artificial intelligence". The Economist (in English). 2017. Retrieved 12 March 2018.

- ↑ Seppo Linnainmaa(1970). The representation of the cumulative rounding error of an algorithm as a Taylor expansion of the local rounding errors. Master's Thesis (in Finnish), Univ. Helsinki, 6–7.

- ↑ Griewank, Andreas (2012). Who Invented the Reverse Mode of Differentiation?. Optimization Stories, Documenta Matematica, Extra Volume ISMP (2012), 389–400.

- ↑ Paul Werbos, "Beyond Regression: New Tools for Prediction and Analysis in the Behavioral Sciences", PhD thesis, Harvard University, 1974.

- ↑ Paul Werbos (1982). Applications of advances in nonlinear sensitivity analysis. In System modeling and optimization (pp. 762–770). Springer Berlin Heidelberg. Online

- ↑ Hawkins, Jeff; Blakeslee, Sandra (2005). On Intelligence. New York, NY: Owl Books. ISBN 978-0-8050-7853-4.

- ↑ "Artificial intelligence can 'evolve' to solve problems". Science | AAAS (in English). 10 January 2018. Retrieved 7 February 2018.

- ↑ 100.0 100.1 Ian Goodfellow, Yoshua Bengio, and Aaron Courville (2016). Deep Learning. MIT Press. Online

- ↑ Hinton, G.; Deng, L.; Yu, D.; Dahl, G.; Mohamed, A.; Jaitly, N.; Senior, A.; Vanhoucke, V.; Nguyen, P.; Sainath, T.; Kingsbury, B. (2012). "Deep Neural Networks for Acoustic Modeling in Speech Recognition – The shared views of four research groups". IEEE Signal Processing Magazine. 29 (6): 82–97. doi:10.1109/msp.2012.2205597.

- ↑ 102.0 102.1 102.2 Schmidhuber, J. (2015). "Deep Learning in Neural Networks: An Overview". Neural Networks. 61: 85–117. arXiv:1404.7828. doi:10.1016/j.neunet.2014.09.003. PMID 25462637.

- ↑ Schmidhuber, Jürgen (2015). "Deep Learning". Scholarpedia. 10 (11): 32832. Bibcode:2015SchpJ..1032832S. doi:10.4249/scholarpedia.32832.

- ↑ Rina Dechter(1986). Learning while searching in constraint-satisfaction problems. University of California, Computer Science Department, Cognitive Systems Laboratory.Online

- ↑ Igor Aizenberg, Naum N. Aizenberg, Joos P.L. Vandewalle (2000). Multi-Valued and Universal Binary Neurons: Theory, Learning and Applications. Springer Science & Business Media.

- ↑ Ivakhnenko, Alexey (1965). Cybernetic Predicting Devices. Kiev: Naukova Dumka.

- ↑ Ivakhnenko, A. G. (1971). "Polynomial Theory of Complex Systems". IEEE Transactions on Systems, Man, and Cybernetics (4): 364–378. doi:10.1109/TSMC.1971.4308320.

- ↑ Research, AI (23 October 2015). "Deep Neural Networks for Acoustic Modeling in Speech Recognition". airesearch.com. Retrieved 23 October 2015.

- ↑ Fukushima, K. (1980). "Neocognitron: A self-organizing neural network model for a mechanism of pattern recognition unaffected by shift in position". Biological Cybernetics. 36 (4): 193–202. doi:10.1007/bf00344251. PMID 7370364.

- ↑ Yann LeCun (2016). Slides on Deep Learning Online

- ↑ Silver, David; Schrittwieser, Julian; Simonyan, Karen; Antonoglou, Ioannis; Huang, Aja; Guez, Arthur; Hubert, Thomas; Baker, Lucas; Lai, Matthew; Bolton, Adrian; Chen, Yutian; Lillicrap, Timothy; Fan, Hui; Sifre, Laurent; Driessche, George van den; Graepel, Thore; Hassabis, Demis (19 October 2017). "Mastering the game of Go without human knowledge" (PDF). Nature. 550 (7676): 354–359. Bibcode:2017Natur.550..354S. doi:10.1038/nature24270. ISSN 0028-0836. PMID 29052630.

AlphaGo Lee... 12 convolutional layers

- ↑ Hyötyniemi, Heikki (1996). "Turing machines are recurrent neural networks". Proceedings of STeP '96/Publications of the Finnish Artificial Intelligence Society: 13–24.

- ↑ P. J. Werbos. Generalization of backpropagation with application to a recurrent gas market model" Neural Networks 1, 1988.

- ↑ A. J. Robinson and F. Fallside. The utility driven dynamic error propagation network. Technical Report CUED/F-INFENG/TR.1, Cambridge University Engineering Department, 1987.

- ↑ R. J. Williams and D. Zipser. Gradient-based learning algorithms for recurrent networks and their computational complexity. In Back-propagation: Theory, Architectures and Applications. Hillsdale, NJ: Erlbaum, 1994.

- ↑ Sepp Hochreiter (1991), Untersuchungen zu dynamischen neuronalen Netzen, Diploma thesis. Institut f. Informatik, Technische Univ. Munich. Advisor: J. Schmidhuber.

- ↑ Schmidhuber, J. (1992). "Learning complex, extended sequences using the principle of history compression". Neural Computation. 4 (2): 234–242. CiteSeerX 10.1.1.49.3934. doi:10.1162/neco.1992.4.2.234.

- ↑ Sepp Hochreiter and Jürgen Schmidhuber; Long Short-Term Memory, Neural Computation, 9(8):1735–1780, 1997

- ↑ Alex Graves, Santiago Fernandez, Faustino Gomez, and Jürgen Schmidhuber(2006). Connectionist temporal classification: Labelling unsegmented sequence data with recurrent neural nets. Proceedings of ICML'06, pp. 369–376.

- ↑ Hannun, Awni; Case, Carl; Casper, Jared; Catanzaro, Bryan; Diamos, Greg; Elsen, Erich; Prenger, Ryan; Satheesh, Sanjeev; Sengupta, Shubho; Coates, Adam; Ng, Andrew Y. (2014). "Deep Speech: Scaling up end-to-end speech recognition". arXiv:1412.5567 [cs.CL].

- ↑ Hasim Sak and Andrew Senior and Francoise Beaufays (2014). Long Short-Term Memory recurrent neural network architectures for large scale acoustic modeling. Proceedings of Interspeech 2014.

- ↑ Li, Xiangang; Wu, Xihong (2015). "Constructing Long Short-Term Memory based Deep Recurrent Neural Networks for Large Vocabulary Speech Recognition". arXiv:1410.4281 [cs.CL].

- ↑ Brynjolfsson, Erik; Mitchell, Tom (22 December 2017). "What can machine learning do? Workforce implications". Science (in English). pp. 1530–1534. Bibcode:2017Sci...358.1530B. doi:10.1126/science.aap8062. Retrieved 7 May 2018.

- ↑ Sample, Ian (18 October 2017). "'It's able to create knowledge itself': Google unveils AI that learns on its own". the Guardian (in English). Retrieved 7 May 2018.

- ↑ "The AI revolution in science" (in English). 5 July 2017. Retrieved 7 May 2018.

- ↑ "Will your job still exist in 10 years when the robots arrive?". South China Morning Post (in English). 2017. Retrieved 7 May 2018.

- ↑ Borowiec, Tracey Lien, Steven (2016). "AlphaGo beats human Go champ in milestone for artificial intelligence". latimes.com. Retrieved 7 May 2018.

- ↑ Brown, Noam; Sandholm, Tuomas (26 January 2018). "Superhuman AI for heads-up no-limit poker: Libratus beats top professionals". Science (in English). pp. 418–424. doi:10.1126/science.aao1733. Retrieved 7 May 2018.

- ↑ Ontanon, Santiago; Synnaeve, Gabriel; Uriarte, Alberto; Richoux, Florian; Churchill, David; Preuss, Mike (December 2013). "A Survey of Real-Time Strategy Game AI Research and Competition in StarCraft". IEEE Transactions on Computational Intelligence and AI in Games. 5 (4): 293–311. CiteSeerX 10.1.1.406.2524. doi:10.1109/TCIAIG.2013.2286295.

- ↑ "Facebook Quietly Enters StarCraft War for AI Bots, and Loses". WIRED. 2017. Retrieved 7 May 2018.

- ↑ "ILSVRC2017". image-net.org (in English). Retrieved 2018-11-06.

- ↑ Schoenick, Carissa; Clark, Peter; Tafjord, Oyvind; Turney, Peter; Etzioni, Oren (23 August 2017). "Moving beyond the Turing Test with the Allen AI Science Challenge". Communications of the ACM. 60 (9): 60–64. arXiv:1604.04315. doi:10.1145/3122814.

- ↑ Hernández-Orallo, José; Dowe, David L.; Hernández-Lloreda, M.Victoria (March 2014). "Universal psychometrics: Measuring cognitive abilities in the machine kingdom". Cognitive Systems Research. 27: 50–74. doi:10.1016/j.cogsys.2013.06.001. hdl:10251/50244.

- ↑ 134.0 134.1 White Paper: On Artificial Intelligence - A European approach to excellence and trust. Brussels: European Commission. 2020. pp. 1. https://ec.europa.eu/info/sites/info/files/commission-white-paper-artificial-intelligence-feb2020_en.pdf.

- ↑ Using AI to predict flight delays, Ishti.org.

- ↑ N. Aletras; D. Tsarapatsanis; D. Preotiuc-Pietro; V. Lampos (2016). "Predicting judicial decisions of the European Court of Human Rights: a Natural Language Processing perspective". PeerJ Computer Science. 2: e93. doi:10.7717/peerj-cs.93.

- ↑ "The Economist Explains: Why firms are piling into artificial intelligence". The Economist. 31 March 2016. Archived from the original on 8 May 2016. Retrieved 19 May 2016.

- ↑ Lohr, Steve (28 February 2016). "The Promise of Artificial Intelligence Unfolds in Small Steps". The New York Times. Archived from the original on 29 February 2016. Retrieved 29 February 2016.

- ↑ Frangoul, Anmar (2019-06-14). "A Californian business is using A.I. to change the way we think about energy storage". CNBC (in English). Retrieved 2019-11-05.

- ↑ Wakefield, Jane (15 June 2016). "Social media 'outstrips TV' as news source for young people". BBC News. Archived from the original on 24 June 2016.

- ↑ Smith, Mark (22 July 2016). "So you think you chose to read this article?". BBC News. Archived from the original on 25 July 2016.

- ↑ Brown, Eileen. "Half of Americans do not believe deepfake news could target them online". ZDNet (in English). Retrieved 2019-12-03.

- ↑ "10 Promising AI Applications in Health Care". Harvard Business Review. 2018-05-10. Archived from the original on 15 December 2018. Retrieved 2018-08-28.

- ↑ Dina Bass (20 September 2016). "Microsoft Develops AI to Help Cancer Doctors Find the Right Treatments". Bloomberg.com. Bloomberg. Archived from the original on 11 May 2017.

- ↑ Gallagher, James (26 January 2017). "Artificial intelligence 'as good as cancer doctors'". BBC News (in British English). Archived from the original on 26 January 2017. Retrieved 26 January 2017.

- ↑ Langen, Pauline A.; Katz, Jeffrey S.; Dempsey, Gayle, eds. (18 October 1994), Remote monitoring of high-risk patients using artificial intelligence, archived from the original on 28 February 2017, retrieved 27 February 2017

- ↑ Kermany, D; Goldbaum, M; Zhang, Kang (2018). "Identifying Medical Diagnoses and Treatable Diseases by Image-Based Deep Learning" (PDF). Cell. 172 (5): 1122–1131.e9. doi:10.1016/j.cell.2018.02.010. PMID 29474911. Retrieved 2018-12-18.

- ↑ Senthilingam, Meera (12 May 2016). "Are Autonomous Robots Your next Surgeons?". CNN. Cable News Network. Archived from the original on 3 December 2016. Retrieved 4 December 2016.

- ↑ "Full Page Reload". IEEE Spectrum: Technology, Engineering, and Science News (in English). Retrieved 2019-09-03.

- ↑ "33 Corporations Working On Autonomous Vehicles". CB Insights. N.p., 11 August 2016. 12 November 2016.

- ↑ West, Darrell M. "Moving forward: Self-driving vehicles in China, Europe, Japan, Korea, and the United States". Center for Technology Innovation at Brookings. N.p., September 2016. 12 November 2016.

- ↑ Burgess, Matt (24 August 2017). "The UK is about to Start Testing Self-Driving Truck Platoons". Wired UK. Archived from the original on 22 September 2017. Retrieved 20 September 2017.

- ↑ Davies, Alex (5 May 2015). "World's First Self-Driving Semi-Truck Hits the Road". WIRED. Archived from the original on 28 October 2017. Retrieved 20 September 2017.

- ↑ McFarland, Matt. "Google's artificial intelligence breakthrough may have a huge impact on self-driving cars and much more". The Washington Post 25 February 2015. Infotrac Newsstand. 24 October 2016

- ↑ "Programming safety into self-driving cars". National Science Foundation. N.p., 2 February 2015. 24 October 2016.

- ↑ ArXiv, E. T. (26 October 2015). Why Self-Driving Cars Must Be Programmed to Kill. Retrieved 17 November 2017, from https://www.technologyreview.com/s/542626/why-self-driving-cars-must-be-programmed-to-kill/

- ↑ Christy, Charles A. (17 January 1990). "Impact of Artificial Intelligence on Banking". latimes.com. Retrieved 2019-09-10.

- ↑ O'Neill, Eleanor (31 July 2016). "Accounting, automation and AI". icas.com (in English). Archived from the original on 18 November 2016. Retrieved 18 November 2016.

- ↑ Robots Beat Humans in Trading Battle. BBC.com (8 August 2001)

- ↑ "CTO Corner: Artificial Intelligence Use in Financial Services – Financial Services Roundtable". Financial Services Roundtable (in English). 2 April 2015. Archived from the original on 18 November 2016. Retrieved 18 November 2016.

- ↑ "Artificial Intelligence Solutions, AI Solutions". www.sas.com.

- ↑ Chapman, Lizette (7 January 2019). "Palantir once mocked the idea of salespeople. Now it's hiring them". latimes.com. Retrieved 2019-02-28.

- ↑ Pham, Sherisse (24 April 2017). "Jack Ma: In 30 years, the best CEO could be a robot". CNNMoney.

- ↑ "Can't find a perfect CEO? Create an AI one yourself". 22 October 2016.

- ↑ Marwala, Tshilidzi; Hurwitz, Evan (2017). Artificial Intelligence and Economic Theory: Skynet in the Market. London: Springer Science+Business Media. ISBN 978-3-319-66104-9.

- ↑ "Miles Education | Future Of Finance | Blockchain Fundamentals for F&A Professionals Certificate". www.mileseducation.com. Archived from the original on 26 September 2019. Retrieved 2019-09-26.

- ↑ Buckley, Chris; Mozur, Paul (22 May 2019). "How China Uses High-Tech Surveillance to Subdue Minorities". The New York Times.

- ↑ "Security lapse exposed a Chinese smart city surveillance system".

- ↑ "AI traffic signals to be installed in Bengaluru soon". NextBigWhat (in English). 2019-09-24. Retrieved 2019-10-01.

- ↑ "Why AI researchers like video games". The Economist. Archived from the original on 5 October 2017.

- ↑ Yannakakis, G. N. (2012, May). Game AI revisited. In Proceedings of the 9th conference on Computing Frontiers (pp. 285–292). ACM.

- ↑ Congressional Research Service (2019). Artificial Intelligence and National Security. Washington, DC: Congressional Research Service. https://fas.org/sgp/crs/natsec/R45178.pdf.

- ↑ Slyusar, Vadym (2019). "Artificial intelligence as the basis of future control networks". Preprint.

- ↑ "Getting to grips with military robotics". The Economist (in English). 25 January 2018. Retrieved 7 February 2018.

- ↑ "Autonomous Systems: Infographic". siemens.com (in English). Retrieved 7 February 2018.

- ↑ Allen, Gregory (February 6, 2019). "Understanding China's AI Strategy". www.cnas.org/publications/reports/understanding-chinas-ai-strategy. Center for a New American Security. Archived from the original on March 17, 2019. Retrieved March 17, 2019.

- ↑ Metz, Cade (15 March 2018). "Pentagon Wants Silicon Valley's Help on A.I." The New York Times. Retrieved 19 March 2018.

- ↑ "Role of AI in travel and Hospitality Industry" (PDF). Infosys. 2018. Retrieved 14 January 2020.

- ↑ "Advanced analytics in hospitality". McKinsey & Company. 2017. Retrieved 14 January 2020.

- ↑ "Current applications of Artificial Intelligence in tourism and hospitality". Sinteza. 2019. Retrieved 14 January 2020.

- ↑ Chang, Hsihui; Kao, Yi-Ching; Mashruwala, Raj; Sorensen, Susan M. (10 April 2017). "Technical Inefficiency, Allocative Inefficiency, and Audit Pricing". Journal of Accounting, Auditing & Finance. 33 (4): 580–600. doi:10.1177/0148558X17696760.

- ↑ Matz, S. C., et al. "Psychological targeting as an effective approach to digital mass persuasion." Proceedings of the National Academy of Sciences (2017): 201710966.

- ↑ Busby, Mattha (30 April 2018). "Revealed: how bookies use AI to keep gamblers hooked". the Guardian (in English).

- ↑ Celli, Fabio, Pietro Zani Massani, and Bruno Lepri. "Profilio: Psychometric Profiling to Boost Social Media Advertising." Proceedings of the 2017 ACM on Multimedia Conference. ACM, 2017 [1]

- ↑ "Thinking Machines: Art and Design in the Computer Age, 1959–1989". The Museum of Modern Art (in English).

- ↑ Retrieved July 29

- ↑ "Unhuman: Art in the Age of AI – State Festival". Statefestival.org. Retrieved 2018-09-13.

- ↑ Chun, Rene (2017-09-21). "It's Getting Hard to Tell If a Painting Was Made by a Computer or a Human".

- ↑ "Understanding AI".

- ↑ "MAK Wien - MAK Museum Wien".

- ↑ "European Platform for Digital Humanism".

- ↑ Graham Oppy (20 January 2015). "Gödel's Incompleteness Theorems". Stanford Encyclopedia of Philosophy. Retrieved 27 April 2016.

These Gödelian anti-mechanist arguments are, however, problematic, and there is wide consensus that they fail.

- ↑ Stuart J. Russell; Peter Norvig (2010). "26.1.2: Philosophical Foundations/Weak AI: Can Machines Act Intelligently?/The mathematical objection". Artificial Intelligence: A Modern Approach (3rd ed.). Upper Saddle River, NJ: Prentice Hall. ISBN 978-0-13-604259-4. "even if we grant that computers have limitations on what they can prove, there is no evidence that humans are immune from those limitations."

- ↑ Mark Colyvan. An introduction to the philosophy of mathematics. Cambridge University Press, 2012. From 2.2.2, 'Philosophical significance of Gödel's incompleteness results': "The accepted wisdom (with which I concur) is that the Lucas-Penrose arguments fail."

- ↑ Russel, Stuart., Daniel Dewey, and Max Tegmark. Research Priorities for Robust and Beneficial Artificial Intelligence. AI Magazine 36:4 (2015). 8 December 2016.

- ↑ Simon, Matt (1 April 2019). "Andrew Yang's Presidential Bid Is So Very 21st Century". Wired – via www.wired.com.

- ↑ "Five experts share what scares them the most about AI". 5 September 2018.

- ↑ Rawlinson, Kevin (29 January 2015). "Microsoft's Bill Gates insists AI is a threat". BBC News. Archived from the original on 29 January 2015. Retrieved 30 January 2015.

- ↑ Holley, Peter (28 January 2015). "Bill Gates on dangers of artificial intelligence: 'I don't understand why some people are not concerned'". The Washington Post. ISSN 0190-8286. Archived from the original on 30 October 2015. Retrieved 30 October 2015.

- ↑ Gibbs, Samuel (27 October 2014). "Elon Musk: artificial intelligence is our biggest existential threat". The Guardian. Archived from the original on 30 October 2015. Retrieved 30 October 2015.

- ↑ Bostrom, Nick (2015). "What happens when our computers get smarter than we are?". TED.

- ↑ 202.0 202.1 Russell, Stuart (October 8, 2019). Human Compatible: Artificial Intelligence and the Problem of Control. United States: Viking. ISBN 978-0-525-55861-3. OCLC 1083694322.

- ↑ Post, Washington. "Tech titans like Elon Musk are spending $1 billion to save you from terminators". Archived from the original on 7 June 2016.

- ↑ "Oracle CEO Mark Hurd sees no reason to fear ERP AI". SearchERP (in English). Retrieved 2019-05-06.

- ↑ "Mark Zuckerberg responds to Elon Musk's paranoia about AI: 'AI is going to... help keep our communities safe.'". Business Insider. 25 May 2018. Retrieved 2019-05-06.

- ↑ "The mysterious artificial intelligence company Elon Musk invested in is developing game-changing smart computers". Tech Insider. Archived from the original on 30 October 2015. Retrieved 30 October 2015.

- ↑ Clark, Jack. "Musk-Backed Group Probes Risks Behind Artificial Intelligence". Bloomberg.com. Archived from the original on 30 October 2015. Retrieved 30 October 2015.

- ↑ "Elon Musk Is Donating $10M Of His Own Money To Artificial Intelligence Research". Fast Company. 15 January 2015. Archived from the original on 30 October 2015. Retrieved 30 October 2015.

- ↑ "Is artificial intelligence really an existential threat to humanity?". Bulletin of the Atomic Scientists. 9 August 2015. Archived from the original on 30 October 2015. Retrieved 30 October 2015.

- ↑ "The case against killer robots, from a guy actually working on artificial intelligence". Fusion.net. Archived from the original on 4 February 2016. Retrieved 31 January 2016.

- ↑ "Will artificial intelligence destroy humanity? Here are 5 reasons not to worry". Vox. 22 August 2014. Archived from the original on 30 October 2015. Retrieved 30 October 2015.

- ↑ "Commentary: Bad news. Artificial intelligence is biased". CNA.

- ↑ 213.0 213.1 213.2 Jeff Larson, Julia Angwin (2016-05-23). "How We Analyzed the COMPAS Recidivism Algorithm". ProPublica (in English). Retrieved 2019-07-23.

- ↑ E McGaughey, 'Will Robots Automate Your Job Away? Full Employment, Basic Income, and Economic Democracy' (2018) SSRN, part 2(3)

- ↑ "Automation and anxiety". The Economist. 9 May 2015. Retrieved 13 January 2018.

- ↑ Lohr, Steve (2017). "Robots Will Take Jobs, but Not as Fast as Some Fear, New Report Says". The New York Times. Retrieved 13 January 2018.

- ↑ Frey, Carl Benedikt; Osborne, Michael A (1 January 2017). "The future of employment: How susceptible are jobs to computerisation?". Technological Forecasting and Social Change. 114: 254–280. CiteSeerX 10.1.1.395.416. doi:10.1016/j.techfore.2016.08.019. ISSN 0040-1625.

- ↑ Arntz, Melanie, Terry Gregory, and Ulrich Zierahn. "The risk of automation for jobs in OECD countries: A comparative analysis." OECD Social, Employment, and Migration Working Papers 189 (2016). p. 33.

- ↑ Mahdawi, Arwa (26 June 2017). "What jobs will still be around in 20 years? Read this to prepare your future". The Guardian. Retrieved 13 January 2018.

- ↑ "Stephen Hawking, Elon Musk, and Bill Gates Warn About Artificial Intelligence". Observer. 19 August 2015. Archived from the original on 30 October 2015. Retrieved 30 October 2015.

- ↑ Iphofen, Ron; Kritikos, Mihalis (2019-01-03). "Regulating artificial intelligence and robotics: ethics by design in a digital society". Contemporary Social Science: 1–15. doi:10.1080/21582041.2018.1563803. ISSN 2158-2041.

- ↑ "Ethical AI Learns Human Rights Framework". Voice of America. Retrieved 10 November 2019.

- ↑ Wendell Wallach (2010). Moral Machines, Oxford University Press.

- ↑ 224.0 224.1 Michael Anderson and Susan Leigh Anderson (2011), Machine Ethics, Cambridge University Press.

- ↑ 225.0 225.1 "Machine Ethics". aaai.org. Archived from the original on 29 November 2014.

- ↑ Rubin, Charles (Spring 2003). "Artificial Intelligence and Human Nature". The New Atlantis. 1: 88–100. Archived from the original on 11 June 2012.

- ↑ Brooks, Rodney (10 November 2014). "artificial intelligence is a tool, not a threat". Archived from the original on 12 November 2014.

- ↑ Chalmers, David (1995). "Facing up to the problem of consciousness". Journal of Consciousness Studies. 2 (3): 200–219. See also this link

- ↑ Steven Horst, (2005) "The Computational Theory of Mind" in The Stanford Encyclopedia of Philosophy

- ↑ Evans, Woody (2015). "Posthuman Rights: Dimensions of Transhuman Worlds". Teknokultura. 12 (2). doi:10.5209/rev_TK.2015.v12.n2.49072.

- ↑ maschafilm. "Content: Plug & Pray Film – Artificial Intelligence – Robots -". plugandpray-film.de. Archived from the original on 12 February 2016.

- ↑ "Robots and Artificial Intelligence". www.igmchicago.org. Retrieved 2019-07-03.

- ↑ Wirtz, Bernd W.; Weyerer, Jan C.; Geyer, Carolin (2018-07-24). "Artificial Intelligence and the Public Sector—Applications and Challenges". International Journal of Public Administration. 42 (7): 596–615. doi:10.1080/01900692.2018.1498103. ISSN 0190-0692.

- ↑ "Elon Musk Warns Governors: Artificial Intelligence Poses 'Existential Risk'". NPR.org (in English). Retrieved 27 November 2017.

- ↑ Campbell, Thomas A. (2019). Artificial Intelligence: An Overview of State Initiatives. Evergreen, CO: FutureGrasp, LLC. http://www.unicri.it/in_focus/files/Report_AI-An_Overview_of_State_Initiatives_FutureGrasp_7-23-19.pdf.

- ↑ White Paper: On Artificial Intelligence - A European approach to excellence and trust. Brussels: European Commission. 2020. pp. 1. https://ec.europa.eu/info/sites/info/files/commission-white-paper-artificial-intelligence-feb2020_en.pdf.

- ↑ Buttazzo, G. (July 2001). "Artificial consciousness: Utopia or real possibility?". Computer. 34 (7): 24–30. doi:10.1109/2.933500.

- ↑ McCauley, Lee (2007). "AI armageddon and the three laws of robotics". Ethics and Information Technology. 9 (2): 153–164. CiteSeerX 10.1.1.85.8904. doi:10.1007/s10676-007-9138-2.

- ↑ Galvan, Jill (1 January 1997). "Entering the Posthuman Collective in Philip K. Dick's "Do Androids Dream of Electric Sheep?"". Science Fiction Studies. 24 (3): 413–429. JSTOR 4240644.

人工智能教科书

- Hutter, Marcus (2005). Universal Artificial Intelligence. Berlin: Springer.

- Jackson, Philip (1985). Introduction to Artificial Intelligence (2nd ed.). Dover. https://archive.org/details/introductiontoar1985jack.

- Luger, George; Stubblefield, William (2004). Artificial Intelligence: Structures and Strategies for Complex Problem Solving (5th ed.). Benjamin/Cummings. ISBN 978-0-8053-4780-7. https://archive.org/details/artificialintell0000luge.

- Neapolitan, Richard; Jiang, Xia (2018). Artificial Intelligence: With an Introduction to Machine Learning. Chapman & Hall/CRC. ISBN 978-1-138-50238-3. https://www.crcpress.com/Contemporary-Artificial-Intelligence-Second-Edition/Neapolitan-Jiang/p/book/9781138502383.

- Nilsson, Nils (1998). Artificial Intelligence: A New Synthesis. Morgan Kaufmann. ISBN 978-1-55860-467-4. https://archive.org/details/artificialintell0000nils.

- Russell, Stuart J.; Norvig, Peter (2009). Artificial Intelligence: A Modern Approach (3rd ed.). Upper Saddle River, New Jersey: Prentice Hall..

- Poole, David; Mackworth, Alan; Goebel, Randy (1998). Computational Intelligence: A Logical Approach. New York: Oxford University Press. ISBN 978-0-19-510270-3. https://archive.org/details/computationalint00pool.

- Winston, Patrick Henry (1984). Artificial Intelligence. Reading, MA: Addison-Wesley. ISBN 978-0-201-08259-3. https://archive.org/details/artificialintell00wins.

- Rich, Elaine (1983). Artificial Intelligence. McGraw-Hill. ISBN 978-0-07-052261-9. https://archive.org/details/ine0000unse.

- Bundy, Alan (1980). Artificial Intelligence: An Introductory Course (2nd ed.). Edinburgh University Press. ISBN 978-0-85224-410-4.

- Poole, David; Mackworth, Alan (2017). Artificial Intelligence: Foundations of Computational Agents (2nd ed.). Cambridge University Press. ISBN 978-1-107-19539-4. http://artint.info/index.html.

人工智能的历史

- Newquist, HP (1994). The Brain Makers: Genius, Ego, And Greed In The Quest For Machines That Think. New York: Macmillan/SAMS.

- Nilsson, Nils (2009). The Quest for Artificial Intelligence: A History of Ideas and Achievements. New York: Cambridge University Press.

进一步阅读

- DH Author, 'Why Are There Still So Many Jobs? The History and Future of Workplace Automation' (2015) 29(3) Journal of Economic Perspectives 3.

- Margaret Boden, Mind As Machine, Oxford University Press, 2006.

- Kenneth Cukier, "Ready for Robots? How to Think about the Future of AI", Foreign Affairs, vol. 98, no. 4 (July/August 2019), pp. 192–98.

- Pedro Domingos, "Our Digital Doubles: AI will serve our species, not control it", Scientific American, vol. 319, no. 3 (September 2018), pp. 88–93.

- Alison Gopnik, "Making AI More Human: Artificial intelligence has staged a revival by starting to incorporate what we know about how children learn", Scientific American, vol. 316, no. 6 (June 2017), pp. 60–65.

- Johnston, John (2008) The Allure of Machinic Life: Cybernetics, Artificial Life, and the New AI, MIT Press.

- Christof Koch, "Proust among the Machines", Scientific American, vol. 321, no. 6 (December 2019), pp. 46–49.

- Gary Marcus, "Am I Human?: Researchers need new ways to distinguish artificial intelligence from the natural kind", Scientific American, vol. 316, no. 3 (March 2017), pp. 58–63.

- E McGaughey, 'Will Robots Automate Your Job Away? Full Employment, Basic Income, and Economic Democracy' (2018) SSRN, part 2(3).

- George Musser, "Artificial Imagination: How machines could learn creativity and common sense, among other human qualities", Scientific American, vol. 320, no. 5 (May 2019), pp. 58–63.

- Myers, Courtney Boyd ed. (2009). "The AI Report". Forbes June 2009

- Raphael, Bertram (1976). The Thinking Computer. W.H.Freeman and Company. ISBN 978-0-7167-0723-3. https://archive.org/details/thinkingcomputer00raph.

- Scharre, Paul, "Killer Apps: The Real Dangers of an AI Arms Race", Foreign Affairs, vol. 98, no. 3 (May/June 2019), pp. 135–44.

- Serenko, Alexander (2010). "The development of an AI journal ranking based on the revealed preference approach" (PDF). Journal of Informetrics. 4 (4): 447–459. doi:10.1016/j.joi.2010.04.001. Archived (PDF) from the original on 4 October 2013. Retrieved 24 August 2013.

- Serenko, Alexander; Michael Dohan (2011). "Comparing the expert survey and citation impact journal ranking methods: Example from the field of Artificial Intelligence" (PDF). Journal of Informetrics. 5 (4): 629–649. doi:10.1016/j.joi.2011.06.002. Archived (PDF) from the original on 4 October 2013. Retrieved 12 September 2013.

- Sun, R. & Bookman, L. (eds.), Computational Architectures: Integrating Neural and Symbolic Processes. Kluwer Academic Publishers, Needham, MA. 1994.

- Tom Simonite (29 December 2014). "2014 in Computing: Breakthroughs in Artificial Intelligence". MIT Technology Review.

- Adam Tooze, "Democracy and Its Discontents", The New York Review of Books, vol. LXVI, no. 10 (6 June 2019), pp. 52–53, 56–57.

编者推荐

集智视频

[]

本中文词条由Thingamabob参与编译,Paradoxist@Paradoxer、Ricky审校,糖糖编辑,如有问题,欢迎在讨论页面留言。

本词条内容源自wikipedia及公开资料,遵守 CC3.0协议。